Грамотная seo оптимизация текста строится на LSI-ключах — это тематическое облако слов, которое доказывает поисковым алгоритмам экспертность вашего контента. Роботы больше не реагируют на прямые вхождения, им нужна смысловая глубина документа.

Из этой статьи вы узнаете принципы сбора скрытой семантики. Мы подробно разберем методы внедрения фраз, оценку качества готового материала и способы автоматизации рутины.

Привет, я Максим из команды Текст-Завода. Каждый день мы парсим поисковую выдачу и анализируем сотни клиентских проектов. Раньше авторы просто вписывали маркерные запросы в заголовки. Сейчас такой подход гарантированно отправит страницу за пределы первой сотни результатов. Поисковые системы научились прекрасно понимать контекст, интент пользователя и ценность материала. Мы создаем статьи, которые сразу забирают трафик. Для этого нужен строгий инженерный подход.

Что такое LSI ключи и почему это не обычные синонимы

Latent Semantic Indexing — это сложный метод анализа естественного языка, который ищет математические связи между словами. Синоним просто заменяет одно слово, а LSI-фраза задает контекст всей статье и глубоко раскрывает суть темы.

Представьте, что вы готовите материал про яблоки. Для копирайтера старой школы синонимы — это фрукты, плоды, ранетки. Но поисковик ждет совершенно другой картины. Если статья про выращивание, робот будет искать термины: саженец, обрезка, удобрение, сорт, урожай, почва. Если материал про технику Apple, нужны другие маркеры: экран, процессор, камера, батарея, экосистема, зарядка.

Это и есть скрытая семантика. Эти слова формируют плотное смысловое облако вокруг основного поискового запроса.

Аналитика показывает, что поведенческие факторы сильно зависят от полноты ответа. В исследовании iTargency эксперты фиксируют уверенный рост длины запросов и массовый переход аудитории на диалоговый поиск.

Пользователи хотят видеть глубокую экспертизу, а не поверхностный рерайт из первых ссылок выдачи. Когда вы добавляете правильные профессиональные термины, вы автоматически расширяете охват страницы по длинным низкочастотным хвостам.

Таблица сравнения подходов к написанию:

| Характеристика подхода | Использование простых синонимов | Внедрение LSI-фраз |

| Главная функция | Избежать тавтологии в абзаце | Максимально раскрыть экспертность |

| Пример (тема: автомобиль) | Машина, авто, транспортное средство | Двигатель, подвеска, расход топлива, ТО |

| Влияние на ранжирование | Практически нулевое | Критически важное для топа |

| Источник получения | Словари русского языка, голова автора | Парсинг выдачи, анализ Wordstat |

| Восприятие роботом | Текст воспринимается как плоский | Документ оценивается как объемный |

Скрытая семантика показывает алгоритмам, что вы действительно разбираетесь в вопросе на профессиональном уровне. Робот не умеет читать текст как живой человек, он лишь считает вероятности правильного соседства слов. Если рядом со словом «ипотека» нет слов «ставка», «банк», «первоначальный взнос», система посчитает материал некачественным.

| Попробуйте собрать свой первый контент-план в Текст-Заводе — 10 статей за 2 900 руб., первый результат через 15 минут. Это избавит вас от необходимости искать все эти семантические связи вручную. |

Как Яндекс определяет релевантность и ключевые слова для сайта

Поисковик использует сложные нейросети для оценки смысловой близости текста к запросу пользователя. Алгоритм сравнивает ваш материал с эталонными документами из топа, проверяя наличие профильных терминов и логичной структуры.

Яндекс давно ушел от простого подсчета вхождений. Собирая ключевые слова для сайта, нужно помнить, что они теперь служат лишь начальными маяками.

Основную работу делает внутренний алгоритм, который опирается на архитектуру трансформеров. Он анализирует огромные массивы данных и понимает смысл целых абзацев. Эксперты портала VC.ru подтверждают, что искусственный интеллект стал фундаментальным инструментом оценки качества площадок.

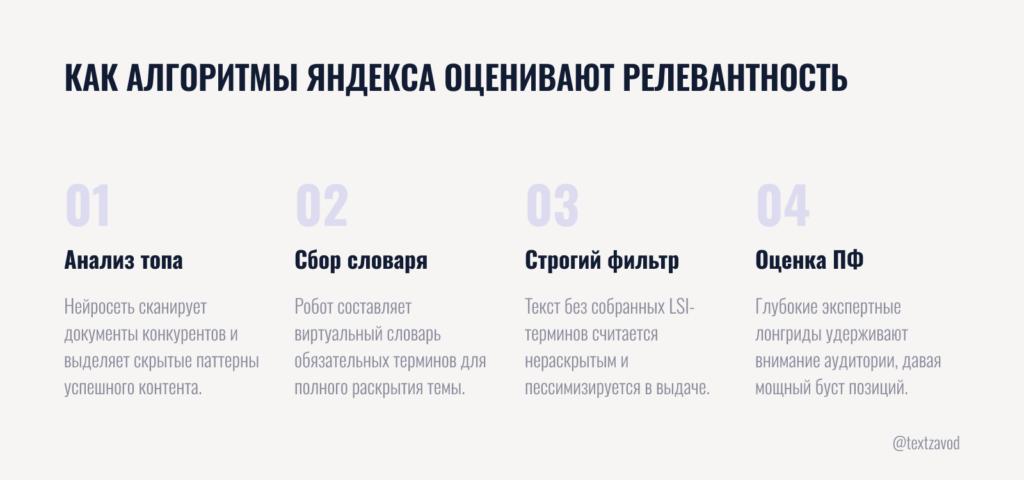

Как именно работает оценка экспертности:

- Нейросеть сканирует документы, которые уже нравятся пользователям в вашей нише. Она выделяет скрытые паттерны успешного контента.

- Робот составляет виртуальный словарь обязательных терминов. Без них тема считается нераскрытой и пессимизируется в выдаче.

- Ваш текст пропускается через этот строгий фильтр. Если словарь совпадает — страница получает огромный плюс к ранжированию.

- Оцениваются поведенческие факторы. Длинные экспертные лонгриды удерживают внимание аудитории гораздо дольше.

Когда мы проектировали семишаговую логику платформы Текст-Завод весной 2026 года, мы учли эти алгоритмические особенности. Наш скрипт применяет Playwright для глубокого парсинга конкурентов и SerpAPI для точного сбора выдачи. Мы не просто отправляем запрос в языковую модель. Сначала мы собираем жесткий каркас терминов, который требует алгоритм.

Разница между коммерческим и информационным интентом

Алгоритмы четко разделяют потребности живых людей. Для интернет-магазина облако фраз будет состоять из слов: цена, купить, доставка, гарантия, корзина. Для блога нужны другие слова: как выбрать, инструкция, отзывы, подробный обзор, характеристики. Смешивать эти разные интенты очень опасно. Если информационная статья перегружена коммерческими маркерами, она быстро выпадет из топа.

Где искать скрытую семантику и подсказки для статей

Скрытые слова можно найти в колонках Wordstat, живых поисковых подсказках, блоке похожих запросов и текстах успешных конкурентов. Ручной сбор занимает часы, но дает хорошую чистую базу.

Вы можете собрать матрицу профильных терминов самостоятельно. Это очень кропотливая ручная работа, но она жизненно необходима для каждого серьезного лонгрида. Мы регулярно сталкиваемся с проектами, которые застряли на второй странице выдачи только из-за отсутствия глубокой проработки смежных тем.

Яндекс Wordstat и его скрытые возможности

Это самый базовый бесплатный инструмент маркетолога. Вы вбиваете главный маркер и внимательно смотрите обе колонки. Левая покажет хвосты запросов — конкретные уточнения, которые используют люди. Правая колонка демонстрирует семантические ассоциации. Там часто скрываются отличные идеи для новых текстовых блоков вашей статьи.

Таблица базовых инструментов для сбора семантики:

| Название инструмента | Главная задача в SEO | Ключевые преимущества для специалиста |

| Яндекс Wordstat | Базовый сбор частотности | Бесплатный доступ к точной статистике рунета |

| SerpAPI | Сбор поисковой выдачи | Позволяет быстро спарсить топ сильных конкурентов |

| Подсказки Яндекса | Поиск длинных хвостов | Отражают самые свежие микро-тренды аудитории |

| Playwright скрипты | Глубокий парсинг сайтов | Легко обходит блокировки при сборе терминов |

Поисковые подсказки и блок Люди ищут

Начните вводить фразу в строку поиска, и умная система сама предложит варианты продолжения. Это самые горячие тренды, которые еще не попали в глобальную статистику, но уже сильно интересны людям. В самом низу страницы поисковой выдачи есть отдельный блок с похожими запросами. Обязательно берите оттуда готовые идеи для подзаголовков H2 или H3.

Анализ конкурентов из первой десятки

Самый надежный и проверенный способ — детально посмотреть на тех, кто уже преуспел. Откройте сайты из топа в режиме инкогнито. Тщательно изучите их структуру, подзаголовки, профессиональную терминологию. Выпишите все узкие слова, которые они регулярно используют. Это и есть ваш золотой запас для ранжирования.

| Если устали тратить время на ручной анализ поисковой выдачи — Текст-Завод парсит топ-30 и строит контент-план сам. Платформа вытянет всю нужную семантику за пару кликов. |

Сколько тематических слов нужно в тексте и куда их вставлять

Жестких правил по точному количеству нет, главное — естественность и органичность чтения. Профессиональные термины распределяют по всей длине страницы: в заголовки, списки, таблицы и атрибуты картинок.

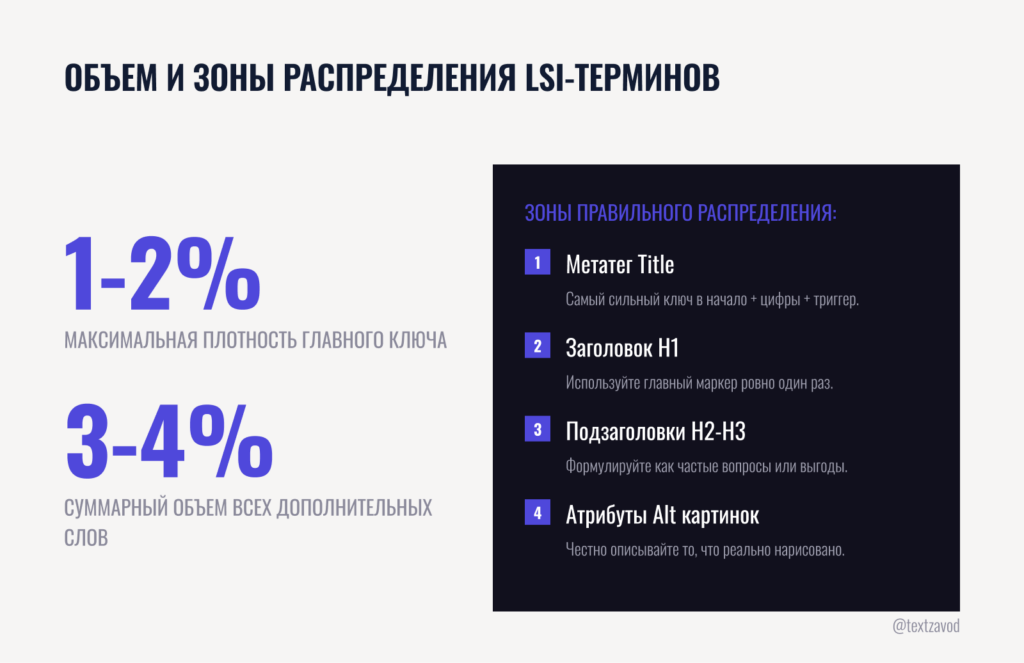

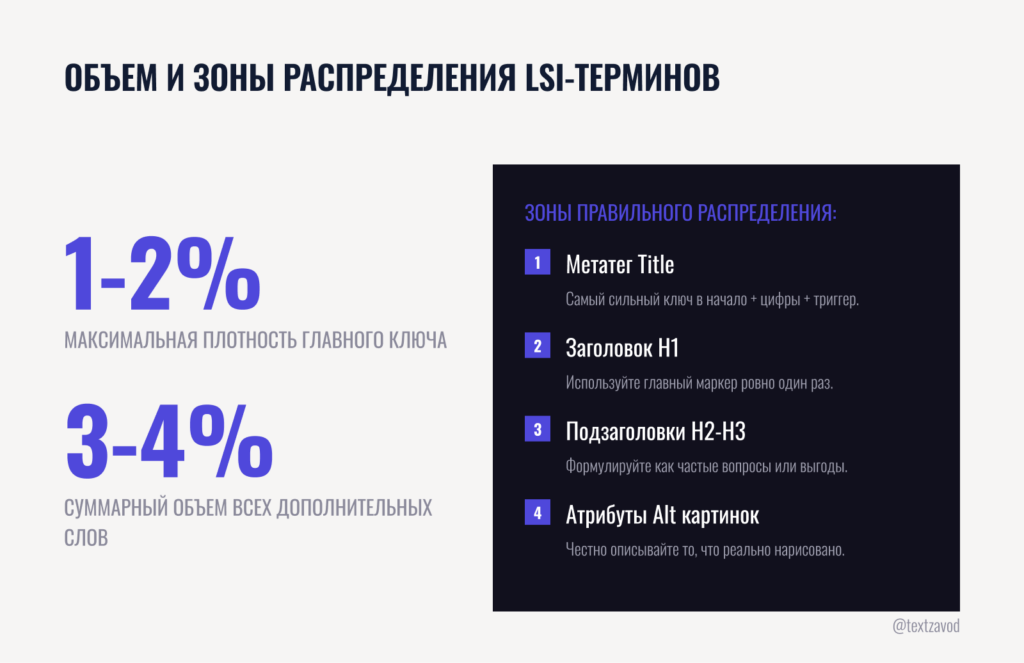

Плотность вхождений — это давно устаревшая метрика, но базовые гигиенические границы соблюдать все-таки нужно. Основной ключ должен занимать около одного-двух процентов от всего объема текста. Все остальные слова суммарно — не больше трех-четырех процентов. Если плотность выше, есть огромный риск попасть под текстовый фильтр.

Зоны правильного распределения LSI-фраз:

- Метатег Title. Ставьте самый сильный ключ в начало, добавляйте цифры и мощный триггер для клика.

- Заголовок H1. Используйте главный ключ ровно один раз на всю страницу, без спама.

- Подзаголовки H2-H3. Формулируйте их как частые вопросы или конкретные выгоды для читателя.

- Основной массив текста. Вплетайте термины органично, смело используйте любые склонения и синонимы.

- Атрибуты Alt картинок. Честно описывайте то, что реально нарисовано на вашем графическом файле.

Как правильно писать полезные метатеги

Title должен моментально цеплять внимание в выдаче. Оптимальная длина заголовка — около 60 символов. Тег Description позволяет раскрыть суть предложения подробнее, туда помещается до 150 знаков. Используйте там конкретную пользу и четкий призыв к действию.

Естественность чтения прежде всего

Ключи нужно вплетать так, чтобы при чтении вслух они звучали абсолютно нормально. Забудьте про жуткие конструкции вроде «пластиковые окна москва купить недорого». Пишите тексты для людей: «у нас можно купить недорогие пластиковые окна в Москве». Поисковик прекрасно понимает падежи, любые склонения и даже разбиение фразы знаками препинания.

| Хотите посмотреть, как это работает вживую? Зайдите на textzavod.ru — там есть примеры готовых статей и отчетов проверки. Вы сразу увидите реальные метрики качества. |

Как проверить готовый материал и не получить фильтр за переспам

Перед публикацией текст обязательно нужно прогнать через автоматические анализаторы. Внимательно оценивайте процент воды, классическую тошноту, а также уникальность и стилистику материала.

Написание статьи — это только половина большого дела. Вторая половина — строгая техническая проверка. В платформе Текст-Завод мы внедрили мощную тройную систему контроля качества, потому что цена ошибки на клиентских проектах слишком высока.

Ключевые метрики качества текста

Анализаторы помогают увидеть готовый текст глазами бездушного поискового робота. Всегда обращайте пристальное внимание на следующие технические параметры:

- Водность текста. Она должна быть минимальной. Смело убирайте пустые вводные конструкции, стоп-слова и лишние местоимения.

- Академическая тошнота. Этот важный показатель отражает частоту повторения самых популярных слов. Держите его в пределах строгой нормы.

- Уникальность контента. Любой плагиат совершенно недопустим. Мы всегда добиваемся стопроцентной уникальности по базе text.ru, чтобы исключить риски.

- Детекция нейросетей. Поисковики активно борются с дешевым машинным контентом. Качественный глубокий промптинг снижает AI-детекцию до 15 процентов.

Таблица зон риска при текстовом переспаме:

| Техническая метрика | Нормальное значение | Возможный риск при сильном превышении |

| Плотность главного ключа | Строго до 2 процентов | Жесткий текстовый фильтр Баден-Баден |

| Академическая тошнота | Обычно до 8 процентов | Быстрая пессимизация конкретной страницы |

| Общий процент воды | Не более 15 процентов | Потеря экспертного смыслового веса документа |

| Уникальность по text.ru | Желательно от 95 процентов | Полное исключение страницы из индекса Яндекса |

Инструменты для глубокой проверки

Используйте сервис Advego для детального семантического анализа. Главред отлично поможет вычистить канцелярит и сложные неповоротливые обороты. Сервис Тургенев покажет риск попадания под стилистические фильтры. Комплексный подход гарантирует отличный результат и высокие позиции.

| Попробуйте Trial: 10 статей, полный цикл от анализа до публикации. Один клиент окупает все первоначальные затраты на автоматизацию. |

Типичные ошибки при работе с околотематическими фразами

Самая частая ошибка — бездумное перечисление профильных терминов через запятую в конце статьи. Также неопытные авторы часто собирают семантику из разных интентов или используют нерелевантные слова.

За годы плотной работы мы видели сотни загубленных сайтов. Большинство критических ошибок совершается из-за полного непонимания принципов работы нейросетей. Когда мы делали аудит одного крупного портала, выяснилось, что копирайтеры просто прятали блоки текста с LSI-ключами под цвет фона. Это прямой путь в пожизненный бан.

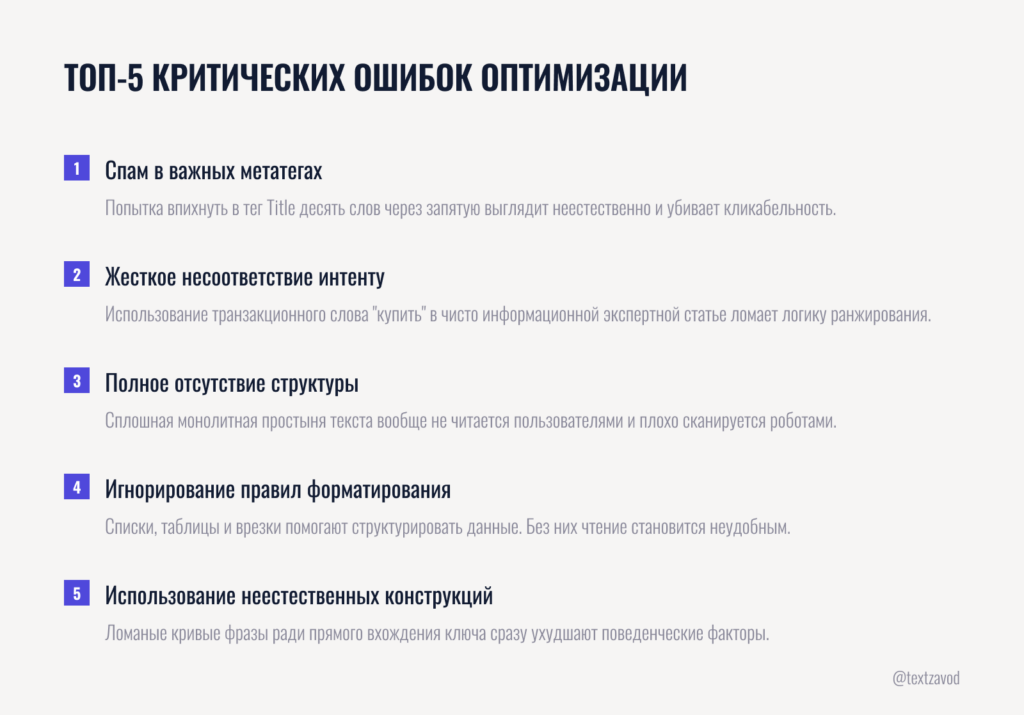

Список самых критических ошибок:

- Спам в важных метатегах. Попытка впихнуть в тег Title десять слов через запятую выглядит неестественно и убивает кликабельность.

- Жесткое несоответствие интенту. Использование слова «купить» в чисто информационной экспертной статье ломает логику ранжирования.

- Полное отсутствие структуры. Сплошная монолитная простыня текста вообще не читается пользователями и плохо сканируется роботами.

- Игнорирование правил форматирования. Списки, таблицы и врезки помогают структурировать данные и делают чтение удобным.

- Использование неестественных конструкций. Ломаные кривые фразы сильно портят впечатление и сразу ухудшают поведенческие факторы.

Помните, что хороший видеоконтент тоже сильно влияет на итоговое ранжирование. По свежим данным портала Texterra, поисковики все чаще показывают ролики в топе по сложным запросам обзоров. Интеграция мультимедиа улучшает глубину просмотра и снижает процент отказов.

Оптимизация скорости загрузки сайта — еще один критически важный технический фактор. Тяжелые неоптимизированные картинки могут свести на нет все ваши усилия по текстам. Сокращайте размер изображений и используйте современные форматы.

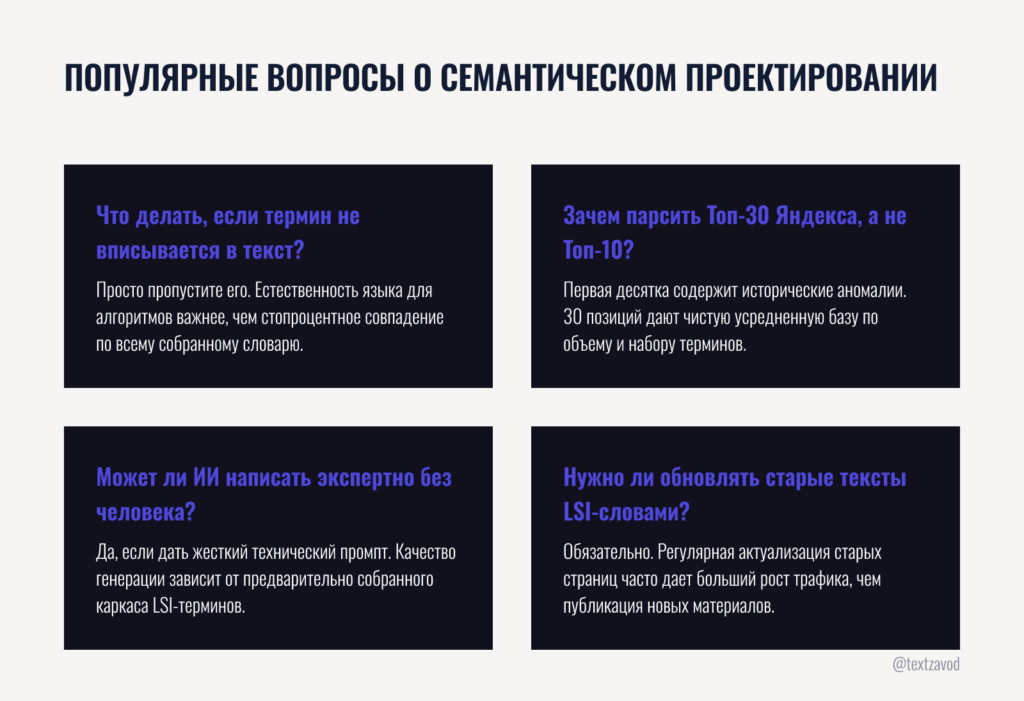

Популярные вопросы о семантическом проектировании

В этом коротком блоке мы собрали прямые ответы на частые вопросы от наших клиентов. Они помогут избежать самых базовых ошибок при запуске новых контентных проектов.

Мы постоянно общаемся с маркетологами и SEO-специалистами разного уровня. У многих возникают похожие обоснованные сомнения при переходе на новые автоматизированные форматы работы.

Что делать, если нужные термины никак не вписываются в текст?

Просто пропустите их. Гораздо лучше потерять один сложный термин, чем сделать предложение кривым и нечитаемым. Роботы ценят общую естественность языка выше, чем точное совпадение по всему собранному словарю.

Зачем парсить именно топ-30 Яндекса, а не топ-10?

Первая десятка слишком узка и может содержать исторические аномалии. Тридцать позиций дают хорошую репрезентативную выборку. Мы берем усредненные медианные значения по объему, структуре и набору терминов.

Может ли машина написать экспертно без участия человека?

Да, если дать алгоритмам правильные входные данные. Качество генерации зависит от промпта и собранной фактуры. В Текст-Заводе мы используем Claude Opus для глубокого анализа семантики, а Gemini Flash генерирует тексты, опираясь на жесткий каркас терминов.

Как быстро новый текст начнет приносить стабильный трафик?

Все сильно зависит от текущего траста вашего домена. На старых сайтах статьи индексируются и дают клики за пару дней. Совершенно новым проектам требуется несколько месяцев для выхода из первичной песочницы.

Нужно ли обновлять старые тексты новыми LSI-словами?

Это нужно делать обязательно. Интент аудитории меняется, появляются новые отраслевые термины. Регулярная актуализация старых трафиковых страниц часто дает больший рост показателей, чем написание новых материалов.

| Читайте подробнее о том, как работает платформа, на textzavod.ru. |

#lsiключи #seoяндекс #оптимизациятекста #ключевыеслова #seo2026