Сделать полноценный seo аудит сайта бесплатно можно даже после ухода западных сервисов. В этом материале мы рассмотрим три рабочих парсера для решения технических задач в России. Привет, на связи Максим из команды Текст-Завода. Вы узнаете сильные стороны Screaming Frog, особенности настройки Netpeak Spider и преимущества бесплатного SiteAnalyzer. Мы также покажем конкретные кейсы и поможем выбрать подходящую программу под ваш бюджет и размер проекта.

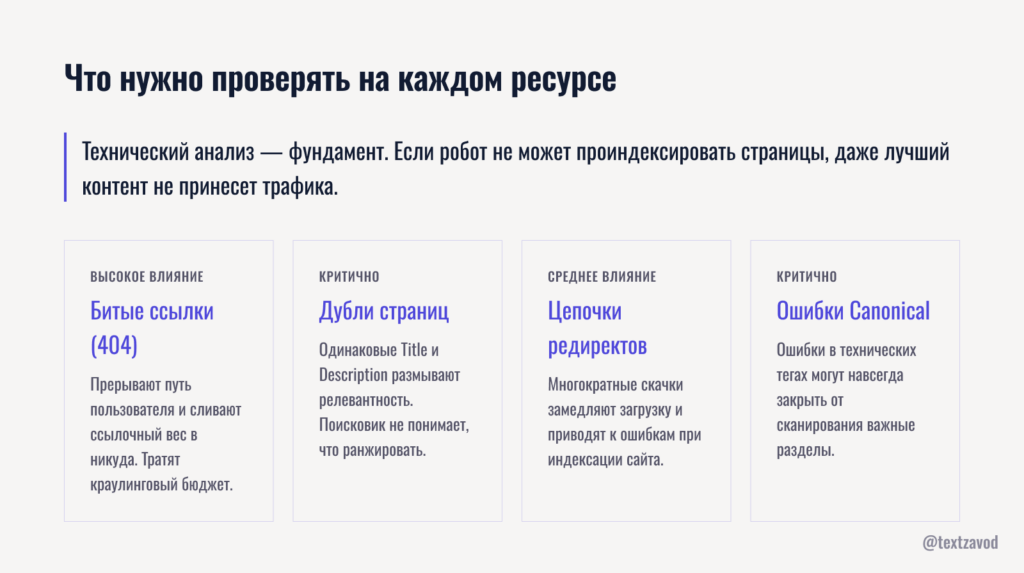

Что нужно проверять на каждом ресурсе

Качественный парсинг помогает найти критические ошибки до того, как они уронят трафик. Базовый технический срез включает поиск битых ссылок, выявление дублей, проверку редиректов и анализ мета-тегов.

Технический анализ — это фундамент продвижения. Если поисковой робот не может нормально проиндексировать страницы, даже самый качественный контент не принесет трафика. Мы в Текст-Заводе часто сталкиваемся с ситуациями, когда клиенты вливают огромные бюджеты в покупку дорогих ссылок, а сайт висит в жесткой стагнации просто из-за циклических редиректов внутри структуры.

Сразу перейдем к обязательным элементам проверки. Независимо от выбранного вами софта, вам предстоит тщательно изучить несколько ключевых метрик для оценки здоровья домена.

- Битые ссылки или страницы с кодом ответа 404. Они прерывают путь пользователя и сливают внутренний ссылочный вес в никуда. Поисковые роботы Яндекса тратят краулинговый бюджет на сканирование пустых адресов, игнорируя новые полезные материалы.

- Дубли страниц и технических мета-тегов. Одинаковые Title и Description сильно размывают релевантность документа. Поисковая система просто не понимает, какую страницу из похожих ранжировать выше в выдаче по конкретному запросу.

- Цепочки редиректов и циклические перенаправления. Многократные скачки с одного адреса на другой замедляют загрузку и часто приводят к ошибкам при индексации. Идеально — когда стоит один прямой 301 редирект на нужный итоговый URL.

- Технические мета-теги Robots и атрибуты Canonical. Мелкие ошибки в этих атрибутах могут навсегда закрыть от сканирования важные коммерческие разделы интернет-магазина.

- Скорость ответа сервера и размер HTML-кода. Тяжелые страницы с огромным количеством лишнего кода негативно влияют на поведенческие факторы. Пользователи закрывают вкладку до полной прогрузки картинок.

- Структура заголовков H1-H6. Парсеры собирают всю иерархию подзаголовков, позволяя найти страницы с отсутствующим главным ключом или нарушенной логикой повествования.

Ниже представлена таблица приоритетности базовых технических проверок для любого вебмастера.

| Элемент проверки | Влияние на SEO | Сложность исправления | Инструмент контроля |

| Битые ссылки (404) | Высокое | Низкая | Любой базовый краулер |

| Дубли контента | Критичное | Средняя | Инструмент парсинга тегов |

| Цепочки редиректов | Среднее | Средняя | Карта сайта XML |

| Ошибки Canonical | Критичное | Высокая | Ручной анализ кода |

| Пустые Title | Высокое | Низкая | Массовая проверка мета-тегов |

| Попробуйте собрать свой первый контент-план в Текст-Заводе — 10 статей за 2 900 руб., первый результат через 15 минут. Это снимет с вас тяжелую рутину с подбором тем, пока вы занимаетесь глубокой технической оптимизацией. |

Screaming Frog как самый мощный инструмент на рынке

Лягушка остается золотым стандартом индустрии для глубокого анализа больших порталов. У нее сложный интерфейс, но возможности кастомизации поиска покрывают любые задачи технического специалиста.

Этот софт стабильно выбирают за надежность и невероятную гибкость пользовательских настроек. Когда мы делали срез по крупному столичному e-commerce на миллион товарных позиций, выяснилось, что только Screaming Frog смог вытянуть весь массив данных без критического падения программы. Конечно, потребовался мощный выделенный сервер для запуска процесса.

По свежим данным исследования TechRadar, базовая стоимость годовой лицензии в 2026 году составляет 209 фунтов стерлингов. Однако для малых проектов есть официальная бесплатная версия с жестким ограничением до 500 URL.

Преимущества программы при детальном рассмотрении:

- Полноценный рендеринг JavaScript. Инструмент отлично справляется с тяжелыми сайтами на React или Vue. Вы получаете итоговый DOM-контент страницы, который видит реальный робот Google при загрузке.

- Кастомный парсинг данных. Вы можете собирать абсолютно любые текстовые элементы страницы по XPath или Regex правилам. Мы часто используем эту полезную функцию для массовой выгрузки цен конкурентов прямо из товарной разметки.

- Прямая интеграция по API. Программа напрямую связывается с аккаунтами Google Search Console и PageSpeed Insights. Данные о кликах и скорости подтягиваются прямо в итоговую таблицу результатов обхода.

- Встроенный анализ архитектуры сайта. Красивые визуальные графы наглядно показывают структуру перелинковки. Это помогает визуально найти изолированные страницы-«сироты» без единой внутренней ссылки.

- Моделирование robots.txt. Вы можете прописать тестовые правила закрытия разделов и проверить их отработку внутри программы, не загружая файл на боевой сервер.

- Массовая генерация Sitemap. Приложение создает чистые карты сайта с правильными датами обновления и приоритетами страниц на основе реальной структуры ресурса.

| Основная функция Screaming Frog | Бесплатная версия (Free) | Платная версия (Paid) |

| Лимит адресов URL | 500 штук | Без ограничений |

| Интеграция API GSC | Отсутствует | Полная поддержка |

| Рендеринг JS | Недоступен | Присутствует |

| Кастомный сбор информации | Отсутствует | Присутствует |

| Сохранение проектов | Не поддерживается | Доступно всегда |

Для комфортной работы с объемными базами настоятельно рекомендуем выделить под этот тяжелый софт отдельный виртуальный сервер. Глубокий парсинг сильно грузит оперативную память компьютера, парализуя остальную работу системы.

| Хотите посмотреть, как это работает вживую? Зайдите на textzavod.ru — там есть наглядные примеры готовых качественных статей и подробных отчетов проверки, которые мы генерируем полностью автоматически. |

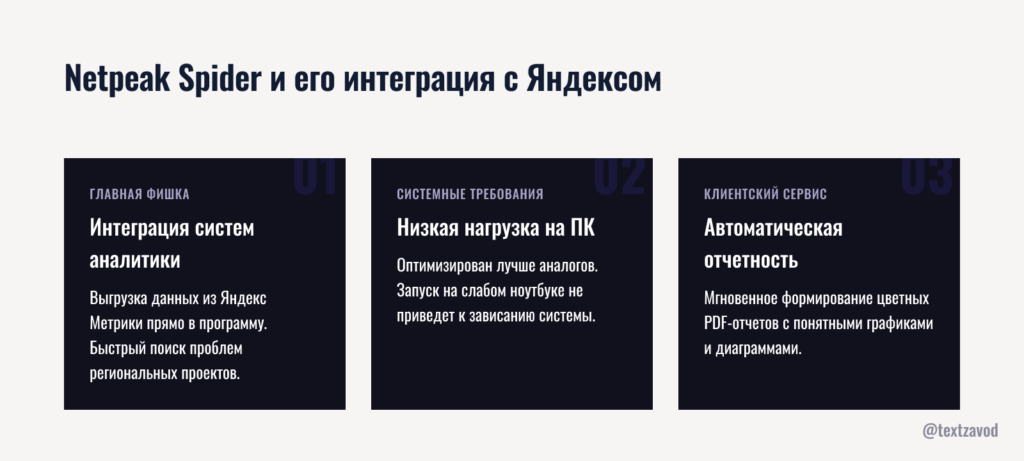

Netpeak Spider и его интеграция с Яндексом

Netpeak Spider сильно выделяется глубокой связкой с локальными аналитическими системами. Он отлично работает с отчетами из Яндекс Метрики и помогает быстро находить критические проблемы региональных коммерческих проектов.

Этот надежный краулер для сайта изначально разрабатывался с четким прицелом на специфические нужды русскоязычного рынка. Интерфейс качественно переведен на русский язык, а встроенные всплывающие подсказки логично объясняют суть каждой технической ошибки. Это максимально снижает порог входа для новичков.

Главная фишка приложения — плотная и стабильная работа с отечественными метриками. Вы можете легко выгрузить данные из систем аналитики прямо в основное рабочее окно программы.

Особенности технической настройки и работы:

- Гибкая сегментация данных. Инструмент позволяет разбивать большой коммерческий проект на отдельные логические части. Вы можете сканировать только информационный блог или только каталог товаров, экономя время.

- Математический расчет внутреннего PageRank. Программа алгоритмически моделирует распределение ссылочного веса по всем страницам. Вы сразу визуально видите, какие глубокие разделы недополучают вес от главной.

- Низкие системные требования к ресурсам ПК. Десктопное приложение оптимизировано гораздо лучше многих тяжеловесных аналогов. Запуск процесса на старом слабом ноутбуке не приведет к зависанию операционной системы.

- Удобный мультиоконный режим. Вы можете без проблем запустить параллельное сканирование сразу нескольких клиентских доменов. Это здорово экономит рабочие часы при аудите большой сетки сайтов.

- Модуль проверки орфографии. Встроенный чекер находит банальные опечатки и грамматические ошибки в текстовом контенте на разных языках.

- Анализ исходного кода на вирусы. Парсер умеет подсвечивать подозрительные внешние ссылки и вредоносные скрипты, вшитые в тело документа без вашего ведома.

Согласно подробным отчетам аналитиков Mordor Intelligence, доля автоматизированных сервисов в рутинных SEO-процессах стремительно растет в 2026 году. Netpeak Spider четко следует этому мировому тренду, предлагая удобный встроенный аудитор буквально в один клик. Программа быстро формирует красивый цветной PDF-отчет для клиента с понятными графиками и диаграммами.

| Характеристика продукта | Значение метрики | Подробный комментарий |

| Порог входа пользователя | Средний | Есть встроенные подсказки |

| Оценка качества интерфейса | 8 из 10 баллов | Логично и чисто выстроен |

| Стартовая стоимость в месяц | Около 22-29 долларов | Часто бывают промо-скидки |

| Клиентская отчетность | Автоматическая | Поддержка форматов PDF и Excel |

| Нагрузка на систему | Низкая | Оптимизированный движок |

| Если устали тратить время на ручной анализ поисковой выдачи — Текст-Завод быстро парсит топ-30 конкурентов и строит матричный контент-план сам. Мы полностью автоматизировали процесс, чтобы вы спокойно сфокусировались на глобальных стратегических решениях. |

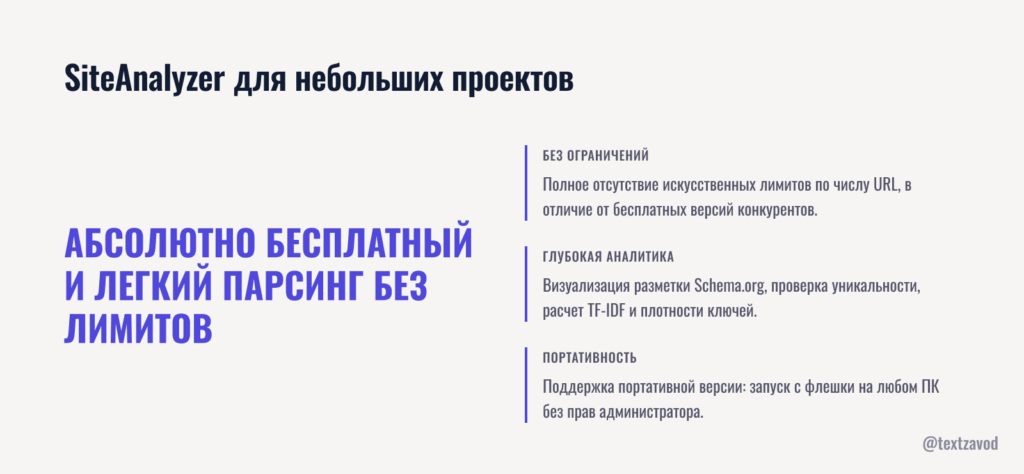

SiteAnalyzer для небольших проектов

Этот легкий десктопный парсер стал настоящей спасительной находкой для независимых фрилансеров и владельцев малого бизнеса. Он предлагает отличный базовый набор функций абсолютно бесплатно и не требует сложных технических настроек.

Отечественный SiteAnalyzer развивается очень динамично и уверенно захватывает нишу. По официальным данным из блога обновлений SiteAnalyzer, за 2025 год они добавили классную визуализацию микроразметки Schema.org и сложный расчет математического параметра TF-IDF для текстового контента.

Программа полностью покрывает все базовые технические потребности для проведения глубокого аудита относительно небольшого информационного ресурса.

Плюсы постоянного использования утилиты:

- Понятный и максимально лаконичный дизайн. Все основные рабочие кнопки выведены крупно на верхнюю панель. Навигация интуитивно ясна и не вызывает ступора у начинающих младших специалистов.

- Полное отсутствие искусственных ограничений по числу URL. В отличие от урезанной триальной версии «лягушки», здесь можно парсить сайты абсолютно любого объема без вложений.

- Проверка контентной уникальности внутри системы. Инструмент умеет программно находить схожие по тексту страницы внутри сканируемого домена, выявляя каннибализацию ключей.

- Регулярные крупные обновления функционала. Российские разработчики внимательно слушают комьюнити и постоянно добавляют новые фичи по запросам активных пользователей.

- Встроенный расчет плотности ключевых слов. Вы можете прямо в программе посмотреть, какие термины чаще всего встречаются на анализируемой посадочной странице.

- Поддержка портативной версии. Программу можно просто закинуть на флешку и запускать на любом офисном компьютере без прав администратора и долгой установки.

| Версия программного продукта | Ограничение количества страниц | Доступный экспорт данных | Цена лицензии |

| Основная SiteAnalyzer Base | Полностью отсутствует | Таблицы CSV, Excel форматы | Бесплатно |

| Браузерное мини-расширение | Только текущая локальная страница | Быстрый буфер обмена | Бесплатно |

Для небольших корпоративных визиток, сайтов локальных услуг или узконишевых мелких магазинов этого технического функционала хватает с головой. Буквально на прошлой неделе мы тестировали его на клиентском сайте автосервиса размером в 300 страниц — полный аудит с выгрузкой отчета занял меньше двух минут.

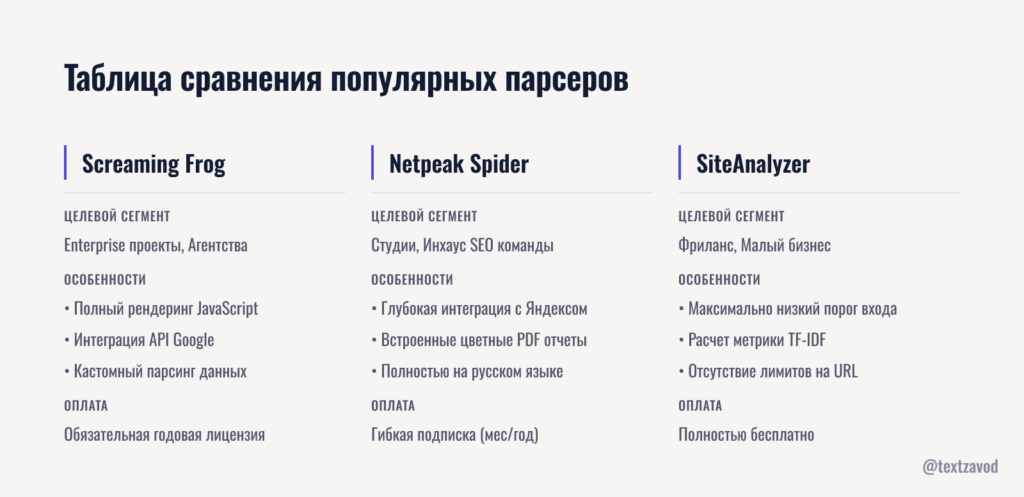

Таблица сравнения популярных парсеров

Выбор конкретного рабочего софта всегда жестко упирается в размер вашего проекта, доступный месячный бюджет и техническую квалификацию команды. Мы аккуратно свели главные параметры трех решений в одну наглядную матрицу.

Грамотный подбор правильного инструмента реально экономит десятки рабочих часов в месяц. Очень важно объективно оценивать не только базовую цену, но и совместимость выбранной программы с вашей текущей инфраструктурой и операционной системой на компьютерах сотрудников.

Ниже представлен детальный сравнительный разбор по ключевым метрикам актуальным на 2026 год.

| Критерий оценки программы | Мощный Screaming Frog | Удобный Netpeak Spider | Легкий SiteAnalyzer |

| Основной целевой сегмент | Enterprise проекты, Агентства | Студии, Инхаус SEO команды | Фриланс, Мелкий малый бизнес |

| Рендеринг скриптов JavaScript | Полная встроенная поддержка | Доступно только в Pro-версии | Пока не поддерживается движком |

| Модель взимания оплаты | Обязательная годовая лицензия | Гибкая подписка (мес/год) | Полностью бесплатно для всех |

| Интеграция сторонних API | Сервисы Google, PageSpeed | Метрики Google, Яндекс | Встроенный расчет метрики TF-IDF |

| Сложность быстрого освоения | Достаточно высокая | Умеренно средняя | Максимально низкая |

| Наличие русскоязычного интерфейса | Отсутствует в базе | Поддерживается из коробки | Поддерживается из коробки |

| Встроенная генерация PDF отчетов | Нет, только табличный экспорт | Присутствует, с графиками | Отсутствует, ручной сбор |

На живой практике мы видим очень четкое сегментированное разделение аудитории. Крупные системные игроки рынка покупают дорогие серверные лицензии Frog, а локальные небольшие команды спокойно комбинируют бесплатный SiteAnalyzer с точечными платными запусками Netpeak для конкретных сложных задач.

| Попробуйте Trial: 10 статей, полный рабочий цикл от стартового анализа до публикации на сайте. Один довольный клиент полностью окупает эти минимальные затраты за пару дней активной работы площадки |

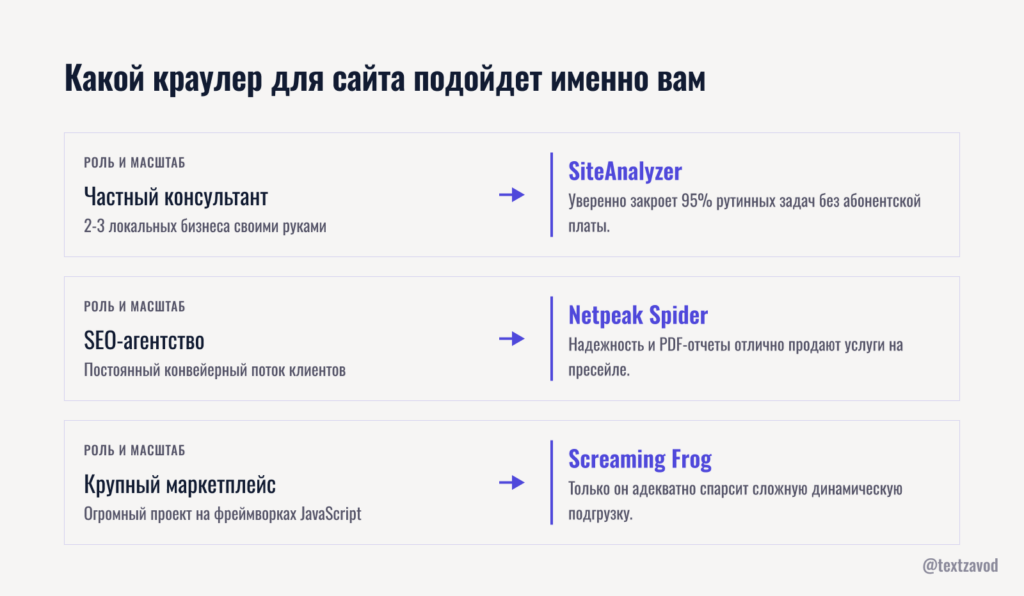

Какой краулер для сайта подойдет именно вам

Итоговый выбор программы напрямую зависит от конкретных задач и масштабов ежедневной работы. Для глубокого шпионского анализа крупных конкурентов нужен мощный безотказный функционал, а для быстрого экспресс-аудита одностраничной визитки хватит бесплатного софта.

Мы всегда рекомендуем отталкиваться от вашей текущей роли в проекте. Серьезным агентствам требуется железобетонная надежность при ежедневной работе с миллионами урлов, а инхаус-специалисту в компании критично важна красивая и понятная отчетность для генерального директора.

Вот несколько типичных рабочих сценариев для ориентации:

- Если вы независимый частный консультант или ведете 2-3 локальных бизнеса своими руками. Смело скачивайте и настраивайте SiteAnalyzer. Он уверенно закроет 95% технических рутинных задач без всякой абонентской платы.

- Если у вас полноценное SEO-агентство полного цикла с постоянным конвейерным потоком клиентов. Ваш идеальный выбор — Netpeak Spider. Классные встроенные PDF-отчеты с яркими графиками отлично продают ваши услуги на сложном этапе пресейла.

- Если вы развиваете гигантский крупный маркетплейс на фреймворках JavaScript. Без британского Screaming Frog точно не обойтись. Только он адекватно и полностью спарсит сложную динамическую подгрузку всех товарных элементов.

- Если вам нужно выгрузить очень специфические скрытые данные. Гибкий XPath-парсинг «лягушки» позволяет достать со страниц абсолютно любые атрибуты, стилистические классы или скрытые программные переменные кода.

- Если вы плотно завязаны на работе с сервисами Яндекса. Интеграция Netpeak позволяет накладывать данные реального трафика поверх технической структуры ресурса, находя популярные, но битые страницы.

В Текст-Заводе мы тоже используем исключительно комплексный подход к автоматизации процессов. Наша интеллектуальная AI-платформа проводит полный цикл создания экспертного контента: мы сами глубоко парсим топ-30 поисковиков, формируем логичную структуру на 25-30 статей и запускаем массовую генерацию через продвинутые нейросети Gemini и Claude.

Для легкого старта карьеры вы можете просто держать бесплатный SiteAnalyzer на личном рабочем ноутбуке, а по-настоящему тяжелые многодневные задачи спокойно делегировать на удаленный сервер с установленным Screaming Frog.

| Читайте подробнее о том, как работает инновационная платформа, на textzavod.ru. Вы гарантированно найдете много полезной практической информации о генерации стабильного трафикового контента. |

Частые вопросы по сканированию ресурсов

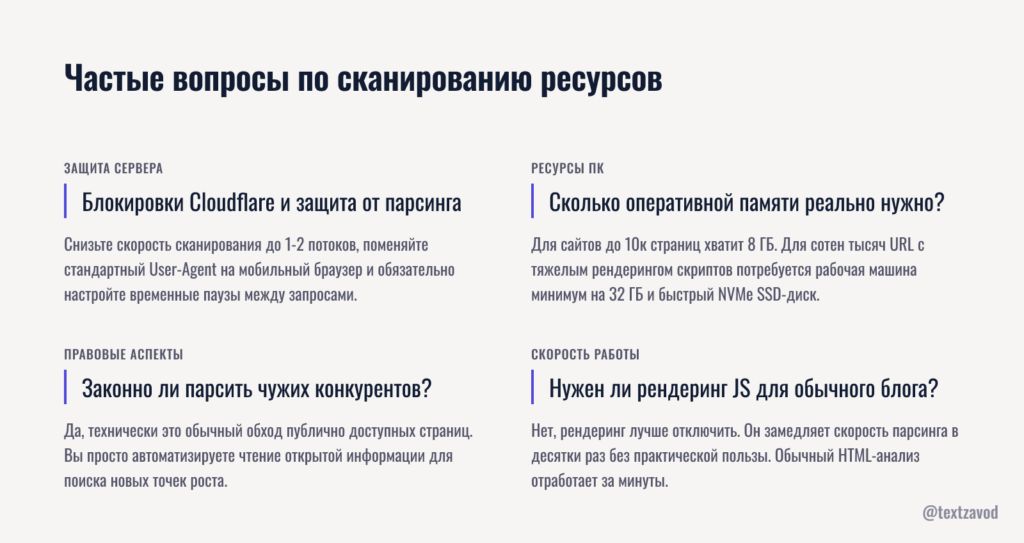

Мы кропотливо собрали список самых типичных проблем, с которыми регулярно сталкиваются пользователи при запуске десктопных программ для глубокого парсинга. Подробный разбор этих ситуаций поможет вам избежать досадных программных зависаний и IP блокировок.

Ясное понимание тонких технических нюансов настройки надежно защищает от внезапной потери собранных данных. Часто начинающие новички забывают просто сохранить проектный файл, и многочасовой тяжелый парсинг приходится печально запускать с нуля.

Разберем ключевые технические детали процесса.

Зачем вообще нужен отдельный платный софт, если есть бесплатные панели вебмастеров?

Системные панели Яндекса и Google показывают пост-фактум информацию о том, что поисковый робот уже давно обошел и с какими конкретно ошибками столкнулся. Десктопная программа на вашем ПК позволяет найти и оперативно исправить косяки до того, как они физически попадут в индекс поисковика и уронят ранжирование.

Что делать, если целевой сервер блокирует запросы краулера и выдает ошибку?

Крупные сайты часто жестко защищены системами вроде Cloudflare от автоматического спама и DDoS-атак. В настройках программы парсинга нужно максимально снизить скорость сканирования до 1-2 потоков, поменять стандартный User-Agent на мобильный или десктопный браузер и обязательно настроить случайные временные паузы между запросами к серверу.

Сколько оперативной памяти реально нужно для нормальной стабильной работы?

Для парсинга типовых информационных сайтов объемом до 10 000 страниц вполне хватит стандартных 8 ГБ памяти ноутбука. Но если вам предстоит анализировать сотни тысяч URL с тяжелым включенным рендерингом скриптов, потребуется серьезная рабочая машина минимум на 32 ГБ оперативки и максимально быстрый NVMe SSD-диск.

Можно ли законно парсить ресурсы чужих конкурентов?

Да, технически это абсолютно обычный пользовательский обход публично доступных страниц сайта. Вы можете спокойно выгрузить структуру разделов, мета-теги, описания и контентные заголовки сильного конкурента, чтобы детально понять логику его коммерческого продвижения и найти новые точки роста для своего личного проекта. В этом нет ничего запрещенного, вы просто автоматизируете чтение открытой информации.

Нужно ли включать рендеринг JavaScript для обычного информационного блога?

Если ваш блог сделан на классическом WordPress или простом движке без сложной динамической подгрузки элементов, рендеринг лучше отключить. Он замедляет скорость парсинга в десятки раз и сильно перегружает процессор компьютера без реальной практической пользы для итогового результата. Обычный HTML-анализ отработает за минуты.