Если страница не индексируется в Яндексе, причина кроется в прямых запретах файла robots.txt, фатальных ошибках сервера или плохом контенте. Поисковик просто экономит краулинговый бюджет на слабые урлы. Ниже мы детально разберем семь главных багов, из-за которых ваши тексты остаются невидимками для поискового робота. Вы получите пошаговые алгоритмы поиска технических ошибок и конкретные способы их быстрого устранения.

Страница создана. Мета-теги есть. В Яндексе ее нет. Почему?

Поисковые алгоритмы стали предельно строго оценивать общее качество площадок. Если робот находит малейший технический баг или видит абсолютно пустую посадочную, он сразу исключает ее из регулярного обхода.

Привет! Я Саша из команды Текст-Завода. Я регулярно наблюдаю эту печальную картину у наших новых клиентов. Вы пишете действительно классный материал, тщательно прописываете мета-теги, ждете трафика, а результата ноль. Чаще всего проблема кроется в банальных мелочах, которые очень легко пропустить при рутинной публикации контента.

По данным свежего аналитического отчета Texterra за 2025 год, алгоритмы стали агрессивнее отсекать слабые URL. Мощная нейросеть YATI 2 мгновенно пессимизирует документы за малейший переспам и шаблонную структуру. Проблемы с индексацией возникают именно из-за игнорирования этих строгих правил игры.

Органическая выдача меняется каждый месяц. Успевать за ней исключительно руками становится практически нереально.

| Если устали тратить время на ручной анализ поисковой выдачи — Текст-Завод парсит топ-30 и строит контент-план сам. Мы берем на себя скучную аналитику, чтобы вы могли спокойно фокусироваться на глобальной стратегии развития бизнеса. |

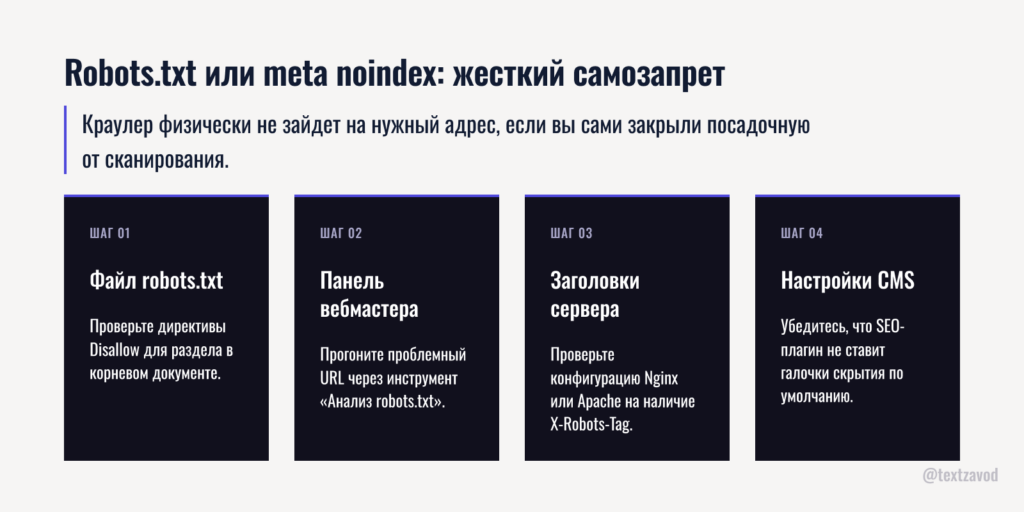

Robots.txt или meta noindex: жесткий самозапрет

Частая ситуация — посадочная закрыта от сканирования вами же. Если программист забыл снять прямой запрет после выкатки нового дизайна, краулер просто физически не зайдет на нужный адрес.

Обязательно откройте исходный код документа и внимательно посмотрите блок head. Если там висит злополучный тег с параметром noindex, поисковая машина честно выполняет вашу команду. То же самое правило касается системного файла robots.txt, который всегда лежит прямо в корне вашего веб-сервера.

Иногда глобальный запрет прописывают на уровне самого сервера, добавляя специальный заголовок X-Robots-Tag. Это коварная штука, которую абсолютно не видно в обычном HTML-коде. Если вы недавно переносили проект с тестового поддомена, вероятность встретить такой сюрприз крайне высока.

Как быстро найти и снять любую блокировку:

- Внимательно проверьте все активные директивы Disallow для нужного раздела в корневом документе.

- Прогоните проблемный урл через специальный инструмент «Анализ robots.txt» в панели вебмастера.

- Попросите системного администратора проверить конфигурацию Nginx или Apache на наличие заголовков X-Robots-Tag.

- Убедитесь, что ваш SEO-плагин в консоли управления не ставит галочки скрытия по умолчанию.

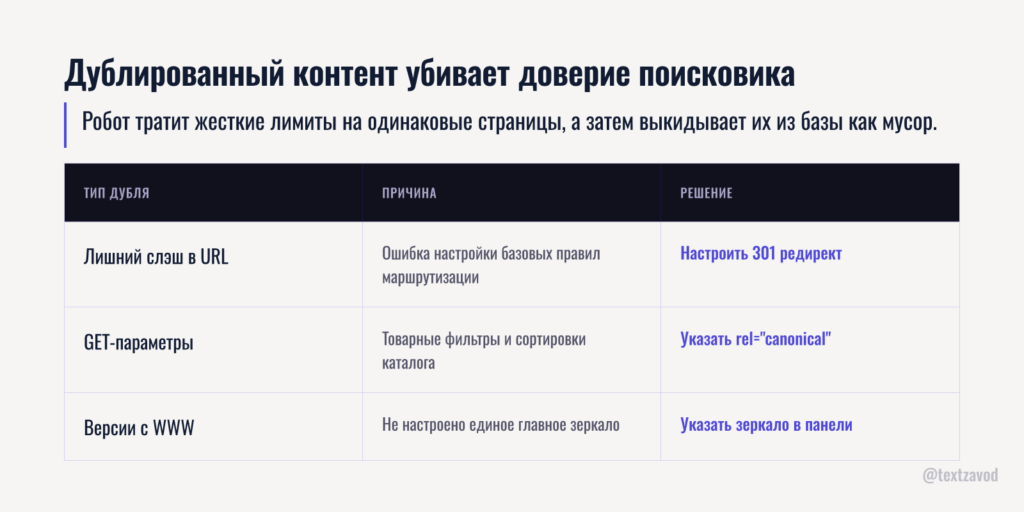

Дублированный контент убивает доверие поисковика

Робот банально не понимает, какую именно версию показывать живым пользователям. Когда в базе слишком много одинаковых текстов, алгоритм безжалостно исключает их все как малополезный мусор.

Любая популярная CMS регулярно генерирует десятки мусорных ссылок с различными GET-параметрами. Это необходимо для корректной работы сортировок по цене, цвету или размеру в большом каталоге. Если вы не настроили канонические ссылки, бот видит сотню абсолютно одинаковых документов.

Он впустую тратит на них свои жесткие лимиты, а потом просто выкидывает из поисковой базы. Аналогичная история постоянно происходит с банальными страницами пагинации в корпоративных блогах. Текст везде один, а фактических адресов очень много.

| Попробуйте собрать свой первый контент-план в Текст-Заводе — 10 статей за 2 900 руб., первый результат через 15 минут. Наш умный сервис сразу создает правильную структуру, избегая риска появления технических дубликатов. |

| Тип технического дубля | Главная причина появления | Как быстро исправить этот баг |

| Лишний слэш в самом конце URL | Ошибка настройки базовых правил маршрутизации на сервере | Корректно склеить адреса через 301 редирект в htaccess |

| Различные GET-параметры в адресной строке | Нормальная работа товарных фильтров и сортировок каталога | Обязательно указать жесткий атрибут rel=»canonical» |

| Версии с приставкой WWW и без нее | Не настроено единое главное зеркало всего вашего проекта | Указать нужное главное зеркало в настройках панели |

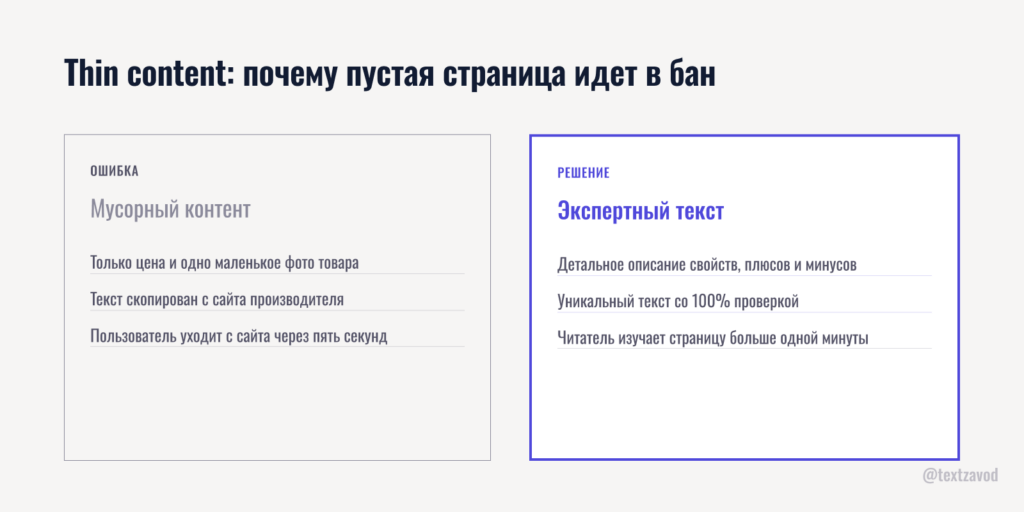

Thin content: почему пустая страница идет в бан

Этот термин означает полностью пустую или малополезную посадочную. Если полезной информации критически мало или она не отвечает на запрос, система посчитает ее цифровым мусором.

Недавно мы проводили глубокий технический аудит крупного интернет-магазина автозапчастей. Оказалось, что тысячи товарных карточек имели только блеклое фото и цену без нормального описания. Искусственный интеллект Яндекса расценивает такие посадочные как некачественные и присваивает им статус малополезных.

Согласно подробному руководству от экспертов PixelPlus, пустые карточки — самая массовая беда для крупных екоммерс проектов. Пользователь открывает ссылку, не видит нужных характеристик и мгновенно возвращается обратно в выдачу. Этот быстрый отказ дает мощный негативный сигнал.

Решать такую масштабную задачу руками просто нерентабельно.

| Читайте подробнее о том, как работает платформа, на textzavod.ru. Мы используем продвинутые модели Gemini и Claude для массовой генерации глубоких описаний, которые нравятся капризным поисковикам. |

| Характеристика контента | Плохой подход (Thin content) | Хороший подход (Экспертный текст) |

| Объем полезного текста | Только цена и одно маленькое фото товара | Детальное описание свойств, плюсов и минусов продукта |

| Уникальность описания | Скопировано с официального сайта производителя | Уникальный текст со 100% проверкой по сервису text.ru |

| Поведенческий фактор | Пользователь уходит с сайта через пять секунд | Читатель изучает страницу больше одной минуты |

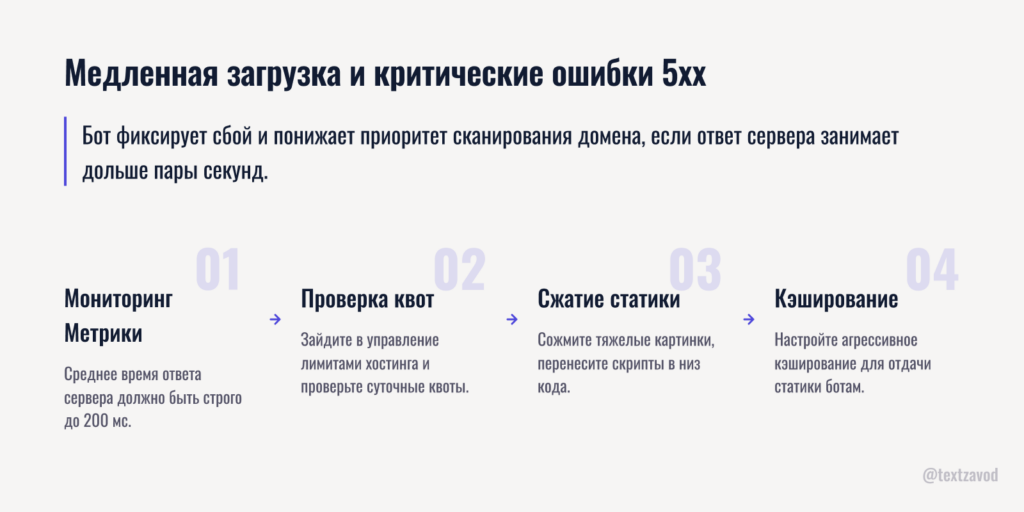

Медленная загрузка и критические ошибки 5xx

Краулер банально не дождался ответа от вашего сервера и прервал текущую сессию. Если хостинг регулярно падает от пиковой нагрузки, бот просто перестанет заходить вообще.

Когда поисковый бот стучится к вам, у него есть очень жесткий лимит времени на ожидание ответа. Если база данных грузится дольше нескольких секунд, возникает критическая ошибка таймаута. Детальное исследование команды Adlook показывает, что статусы группы 5xx чаще всего связаны с нехваткой оперативной памяти.

Особенно часто это случается на дешевых виртуальных серверах, где соседи могут забирать все общие ресурсы. Бот стучится, получает жесткий отказ, фиксирует сбой и понижает приоритет сканирования домена. В итоге свежие материалы могут неделями висеть без органического трафика.

Как надежно ускорить обход:

- Откройте свежие отчеты Метрики и проверьте среднее время ответа сервера — оно должно быть строго до 200 мс.

- Зайдите в раздел управления лимитами и внимательно проверьте текущие суточные квоты.

- Максимально сожмите все тяжелые картинки и перенесите объемные скрипты в самый низ программного кода.

- Настройте агрессивное серверное кэширование, чтобы отдавать статику ботам за считанные доли секунды.

Анализ серверных логов: ищем следы краулера

Серверные логи точно показывают, когда именно приходил бот и какой код ответа он реально получил. Это лучший способ найти скрытые технические проблемы на ранней стадии.

Многие маркетологи полностью игнорируют логи сервера, опираясь только на данные графических панелей. Это большая ошибка. Панель вебмастера показывает общую усредненную картину с задержкой в несколько дней. Логи дают вам точный срез информации секунда в секунду.

Вы можете увидеть, что поисковик тратит огромный бюджет на обход мусорных адресов корзины или формы регистрации. Именно поэтому новые экспертные тексты остаются без должного внимания. Правильный анализ логов помогает перенаправить внимание краулера на нужные разделы.

| Хотите посмотреть, как это работает вживую? Зайдите на textzavod.ru — там есть примеры готовых статей и отчетов проверки. Наш автоматический комплекс гарантирует стопроцентную уникальность и минимальный процент машинной детекции текста. |

| HTTP код ответа | Что означает для Яндекса | Что нужно сделать администратору |

| Код 200 OK | Страница успешно загружена и готова к анализу | Ничего не делать, все работает просто отлично |

| Код 404 Not Found | Документ удален или адрес написан с ошибкой | Настроить правильный 301 редирект на актуальный аналог |

| Код 503 Service Unavailable | Сервер не выдержал нагрузки и временно упал | Оптимизировать тяжелые скрипты или сменить тариф хостинга |

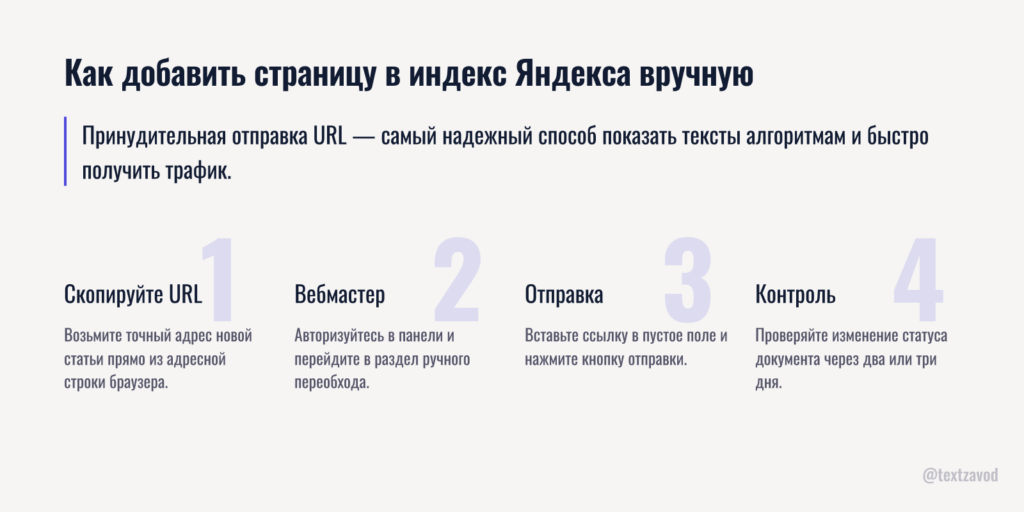

Как добавить страницу в индекс Яндекса вручную

Вы можете принудительно отправить любой важный урл на срочный переобход. Это самый надежный и быстрый способ показать новые тексты алгоритмам и получить первые клики.

Зайдите в официальный кабинет Вебмастера, откройте боковую вкладку «Индексирование» и выберите пункт «Переобход». Вставьте нужные адреса обычным списком и смело нажимайте кнопку отправки. Суточный лимит напрямую зависит от накопленного траста домена, обычно это от ста до нескольких тысяч адресов.

Полезная статья экспертов Kokoc подтверждает, что ручной пинг значительно ускоряет попадание в базу. Если у вас сотни новых урлов ежедневно, настройте автоматическую отправку через популярный IndexNow API. Этот протокол позволяет мгновенно пинговать поисковики о любых изменениях.

Мы в Текст-Заводе полностью автоматизировали эту рутину.

| Попробуйте Trial: 10 статей, полный цикл от анализа до публикации. Один клиент окупает. Наша система умеет сама публиковать материалы в WordPress, Modx или Bitrix без вашего прямого участия. |

Ключевые шаги для быстрой индексации:

- Скопируйте точный адрес новой статьи из адресной строки вашего браузера.

- Авторизуйтесь в панели управления и перейдите в раздел ручного переобхода.

- Вставьте ссылку в пустое текстовое поле и нажмите синюю кнопку отправки.

- Проверяйте изменение текущего статуса документа через два или три дня.

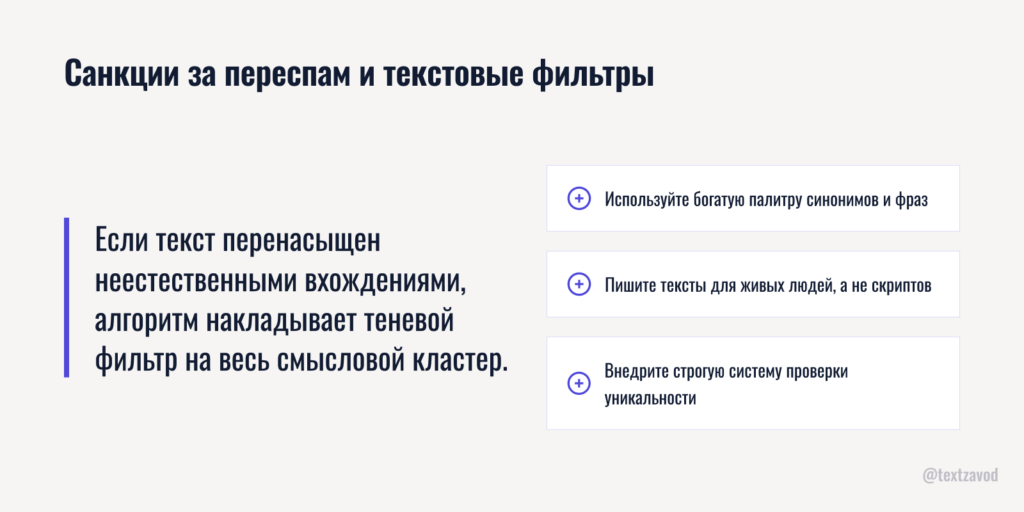

Санкции за переспам и текстовые фильтры

Нейросети научились виртуозно распознавать грубые манипуляции с ключевыми фразами. Если текст перенасыщен неестественными вхождениями, алгоритм накладывает теневой фильтр на весь смысловой кластер.

Времена, когда можно было просто вписать прямой запрос десять раз и получить топ, давно и безвозвратно прошли. Сегодня за такой топорный подход наказывают моментальным исключением из базы данных. Специалисты из Ingate Group отмечают, что текстовые фильтры работают крайне жестко.

Чтобы избежать опасных санкций, используйте богатую палитру синонимов и околотематических фраз. Пишите текст для живых людей, а не для бездушных программных скриптов. Алгоритм оценивает общий смысл абзаца, а не точное совпадение слов.

В нашей работе мы внедрили строгую тройную систему проверки качества каждого генерируемого документа. Мы следим за плотностью ключей, проверяем стилистику и замеряем показатель машинной генерации. Это спасает клиентские проекты от внезапных санкций и потери ценного трафика.

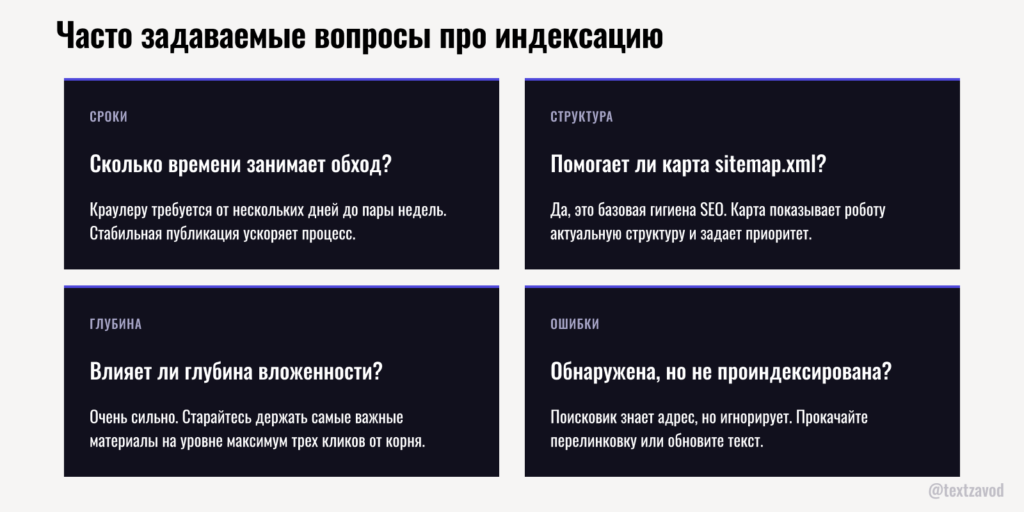

Часто задаваемые вопросы про индексацию

В этом блоке мы собрали самые частые и болезненные вопросы от практикующих SEO-специалистов. Эти короткие ответы помогут вам избежать типичных ошибок новичков.

Сколько времени занимает первичный обход сайта?

Обычно краулеру требуется от нескольких дней до пары полных недель. Если домен совсем новый, бот будет заходить крайне редко. Стабильная публикация свежих материалов сильно ускоряет этот рутинный процесс.

Помогает ли карта сайта sitemap.xml?

Да, это абсолютная базовая гигиена любого технического SEO. Карта показывает роботу актуальную структуру и задает приоритет сканирования нужных адресов. Обязательно укажите прямую ссылку на этот файл в корневом документе.

Можно ли использовать генерацию для продвижения?

Абсолютно. Алгоритмы жестко штрафуют за спам, а не за сам факт использования инструмента. Главное — давать реальную пользу и держать высокую планку качества. Мы генерируем крутые тексты, которые легко проходят проверки.

Что значит статус «Обнаружена, но не проиндексирована»?

Этот неприятный статус означает, что поисковик знает об адресе, но пока не считает его достойным внимания. Прокачайте внутреннюю перелинковку, закупите пару качественных внешних ссылок или кардинально обновите сам текстовый блок.

Влияет ли глубина вложенности на скорость обхода?

Да, влияет очень сильно. Чем больше кликов нужно сделать от главной страницы до статьи, тем меньше шанс быстрого обхода. Старайтесь держать самые важные материалы на уровне трех кликов от корня ресурса.