Привет, я Саша из команды Текст-Завода. Дублированный контент seo — это одинаковые или крайне похожие тексты на разных адресах одного ресурса. Из-за них поисковые роботы путаются, а Яндекс снижает трафик, пессимизируя оба документа.

В этом материале вы найдете причины появления мусорных страниц и механики их быстрого лечения. Мы подробно изучим настройку серверных перенаправлений и правильное внедрение ссылок. Вы получите пошаговые инструкции по работе с консолями поисковиков и узнаете проверенные способы возврата утраченного органического трафика.

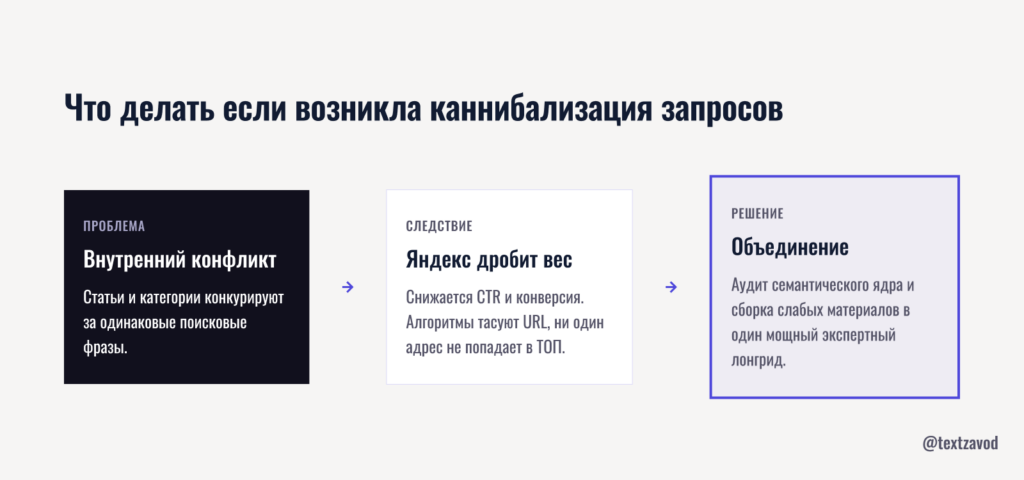

Что делать если возникла каннибализация запросов

Каннибализация возникает при оптимизации нескольких url под одни и те же поисковые фразы. Роботы Яндекса не могут определить самую релевантную страницу и дробят вес между всеми найденными документами. В итоге ни один адрес не попадает в топ выдачи.

Расскажу случай из нашей практики. В начале 2025 года к нам пришел интернет-магазин с резко падающим трафиком. Мы проанализировали семантику через Wordstat и увидели жесткую конкуренцию внутри самого сайта. Большие статьи в блоге напрямую конкурировали с товарными категориями за одни и те же информационные и коммерческие хвосты.

По данным экспертного разбора Search Engine Land, внутреннее соперничество страниц снижает кликабельность (CTR), конверсию и ослабляет обратные ссылки. Поисковик просто дробит показы. Вы сами лишаете себя целевых переходов. Клиент видит в поиске слабые результаты и уходит к конкурентам.

Как обнаружить эту проблему самостоятельно? Самый простой метод — выгрузить статистику из Яндекс Метрики за последний квартал. Отфильтруйте запросы, по которым на сайт переходили пользователи. Если по одному жирному ключу трафик получают сразу три разные страницы — у вас проблемы. Алгоритмы постоянно тасуют эти url. Сегодня высоко ранжируется одна статья, завтра другая.

Список частых причин внутреннего конфликта:

- Одинаковые заголовки — вы публикуете разные статьи, но H1 и Title практически полностью совпадают по смыслу.

- Близкий интент — информационная статья и коммерческий раздел пытаются ответить на смешанный запрос пользователя.

- Плохая перелинковка — вы ставите одинаковые анкоры внутренних ссылок на совершенно разные посадочные url.

Решение всегда кроется в аудите семантического ядра. Нужно четко распределить маркерные запросы по посадочным страницам. Если интенты пересекаются, лучше объединить два слабых материала в один мощный экспертный лонгрид.

| Попробуйте собрать свой первый контент-план в Текст-Заводе — 10 статей за 2 900 руб., первый результат через 15 минут. |

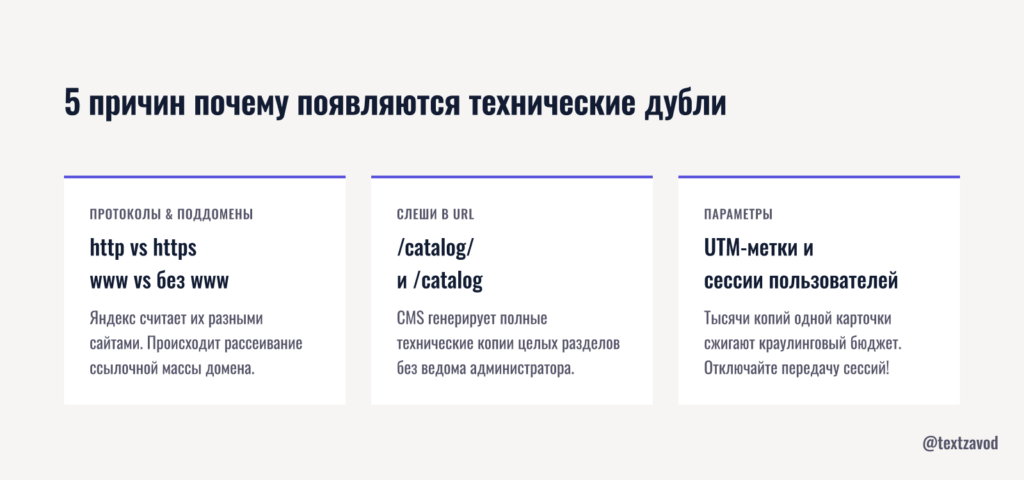

5 причин почему появляются технические дубли

Технические копии генерирует сама система управления сайтом без ведома администратора. Это адреса с www и без них, слеши на конце url и разные http-протоколы. Они стремительно размывают краулинговый бюджет вашего проекта.

Чаще всего мы видим проблемы с utm-метками и параметрами сортировки каталога. Представьте фильтр интернет-магазина. Клиент выбирает красную футболку 44 размера. Адресная строка мгновенно меняется, но текст остается прежним. Яндекс видит сотни одинаковых карточек и начинает понижать хост в ранжировании.

Таблица: Виды технических копий и их особенности

| Тип проблемы | Пример адреса | Влияние на продвижение |

| Протокол | http и https версии | Рассеивание ссылочной массы домена |

| Поддомен | www.site.ru и site.ru | Яндекс считает их разными сайтами |

| Слеши | /catalog/ и /catalog | Создание полных копий разделов |

| Метки | ?utm_source=yandex | Трата краулингового бюджета робота |

Генерация мусора через параметры сессий

Отдельная головная боль seo-специалиста — идентификаторы сессий в адресной строке. Некоторые движки сайтов до сих пор добавляют отдельный параметр в URL для каждого нового посетителя. Тысяча посетителей создает тысячу копий главной страницы магазина. Поисковик просто захлебывается в объеме мусора. Обязательно отключайте передачу сессий через URL в конфигурации сервера.

Первым делом нужно выбрать главное зеркало в панели вебмастера. Затем прописать серверные 301-редиректы в файле конфигурации. Все запросы к страницам с www должны перенаправляться на версию без www. Это базовое правило гигиены ресурса.

| Если устали тратить время на ручной анализ поисковой выдачи — Текст-Завод парсит топ-30 и строит контент-план сам. |

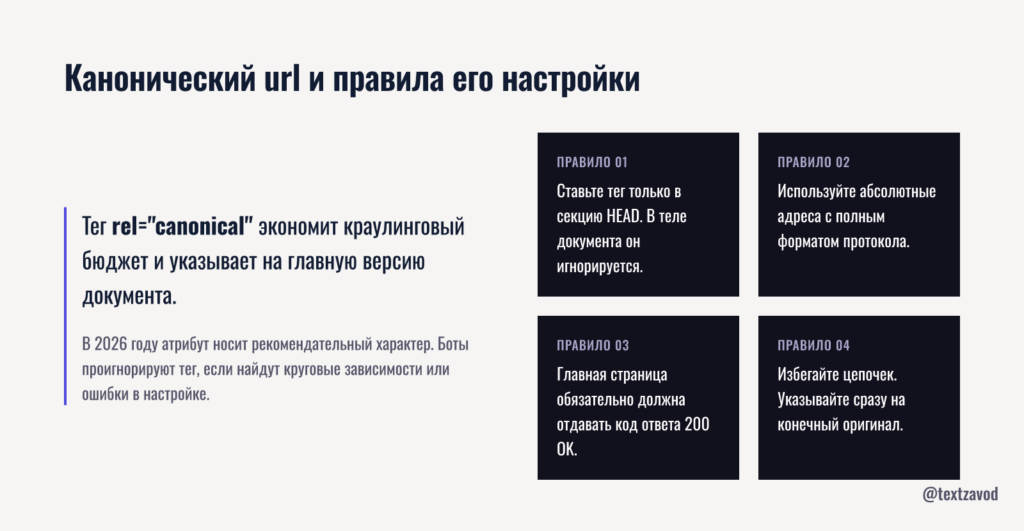

Канонический url и правила его настройки

Атрибут rel=»canonical» указывает роботу Яндекса или Google на главную версию документа среди множества похожих. Поисковик старается индексировать только этот приоритетный адрес. Остальные параметрические копии постепенно исключаются из основной поисковой базы.

В 2026 году требования алгоритмов стали значительно строже. Теперь боты могут игнорировать этот тег, если сочтут тексты недостаточно похожими. Указание приоритетного адреса носит исключительно рекомендательный характер. Если алгоритм решит иначе, он выберет другую версию оригинала.

По данным руководства HostPapa, грамотное внедрение канонических адресов повышает авторитетность страницы и экономит краулинговый бюджет. Роботы перестают тратить время на мусорные копии.

Ошибки при внедрении атрибута

Когда мы анализируем новые проекты, часто видим круговые зависимости ссылок. Страница каталога А ссылается на Б, а Б указывает на А. Это ломает логику индексатора. Еще одна частая ошибка — использование относительного пути вместо абсолютного.

Хорошим тоном в профессиональном сообществе считается установка самоцитирующего атрибута. Это значит, что канонический url должен быть прописан и на самой оригинальной странице. Если парсеры конкурентов скопируют ваш код, поисковик быстрее поймет первоисточник.

Список строгих правил для настройки атрибута:

- Ставьте тег в секцию head — размещение в теле документа игнорируется алгоритмами.

- Используйте абсолютные адреса — полный формат протокола и домена исключает сбои.

- Проверяйте коды ответа — главная страница обязана отдавать статус 200 OK.

- Избегайте длинных цепочек — один документ должен указывать сразу на конечный оригинал.

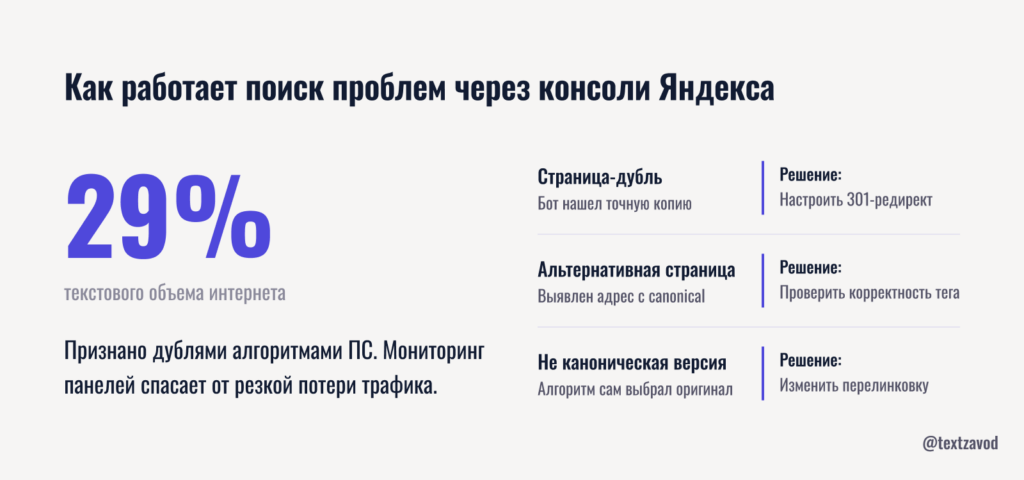

Как работает поиск проблем через консоли Яндекса

Яндекс Вебмастер и Google Search Console — главные бесплатные помощники технического специалиста. Они прямо указывают на исключенные из поиска мусорные адреса. Регулярный мониторинг этих панелей спасает от резкой потери трафика.

Зайдите в панель Яндекс Вебмастера. Откройте раздел со страницами в поиске и внимательно изучите вкладку исключенных URL. Если там появилось много статусов о дублерах, пора останавливать работы и искать пробоину. Система сама нашла уязвимости вашего ресурса. Вам остается только локализовать причину.

В GSC картина обычно еще нагляднее. Согласно свежей статистике Duplicate Content SEO Guide 2026, почти 29% всего текстового объема интернета признано дублями. В консоли Гугла вы увидите точный процент таких страниц на домене.

Таблица: Статусы исключения в консолях и их расшифровка

| Статус в отчете | Что это означает для сайта | Решение проблемы |

| Страница-дубль | Робот нашел точную копию текста | Настроить 301-редирект на оригинал |

| Альтернативная страница | Выявлен адрес с тегом canonical | Проверить корректность атрибута |

| Не каноническая версия | Алгоритм сам выбрал оригинал | Изменить внутреннюю перелинковку |

Анализ файла карты сайта

Не забывайте регулярно проверять файл sitemap.xml. Огромная ошибка — оставлять там битые ссылки или адреса с настроенными перенаправлениями. Карта сайта должна содержать только финальные, отдающие код 200, оригинальные адреса. Любой мусор в карте снижает общее доверие поисковой машины.

| Попробуйте Trial: 10 статей, полный цикл от анализа до публикации. Один клиент окупает. |

3 способа как выбрать и не ошибиться с решением

Для лечения каннибализации и полного устранения технических копий есть три проверенных пути. Вы можете объединить текстовые материалы, настроить серверное перенаправление или жестко удалить лишнее. Выбор зависит от качества органического трафика конкретного url.

Если две статьи борются за топ и мешают друг другу, сначала оцените их профиль. Практика показывает, что консолидация материалов повышает авторитетность итогового документа. Вы берете текст со слабой страницы, переносите его на сильную, а со старого адреса ставите 301-редирект.

Иногда проще отдать серверный код 404. Если страница не несет пользы для клиента, не имеет внешних ссылок и трафика — смело удаляйте ее через систему управления. Не стоит бережно хранить цифровой мусор. Он лишь забирает ресурсы бота.

Список шагов при правильной консолидации текстов:

- Оцените видимость документа — выберите страницу с лучшими поведенческими факторами.

- Перенесите оригинальный текст — добавьте полезные блоки на выбранную главную страницу.

- Настройте серверный редирект — передайте накопленный статический вес по новому адресу.

- Обновите внутренние ссылки — уберите из перелинковки старый удаленный урл.

Использование атрибута robots

Бывают ситуации, когда страница нужна живым пользователям, но совершенно не нужна поиску. Например, корзина, фильтры каталога без ЧПУ или версии для печати. Их лучше всего закрывать мета-тегом robots со значением noindex. Это надежнее блокировки через файл конфигурации robots.txt.

| Хотите посмотреть, как это работает вживую? Зайдите на textzavod.ru — там есть примеры готовых статей и отчетов проверки. |

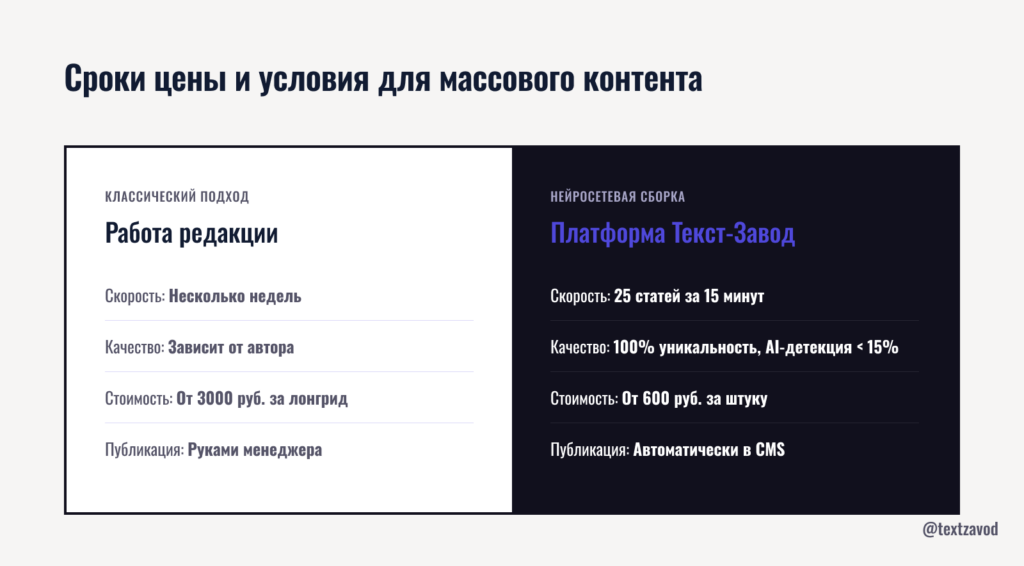

Сроки цены и условия для массового контента

Создание оригинальных текстовых массивов в больших объемах требует жесткого системного подхода. Ручная работа авторов часто приводит к смысловым повторам и потере экспертности. Грамотная автоматизация решает эту проблему быстрее и в разы дешевле.

Мы в Текст-Заводе выстроили надежный и полностью автономный цикл производства. Наша AI-платформа сама парсит топ-30 Яндекса и составляет детальный план на 25-30 тем. Генерация текстов идет через мощнейшие языковые модели Gemini и Claude.

Таблица: Сравнение ручного и автоматического подходов

| Параметр оценки | Работа обычной редакции | Платформа Текст-Завод |

| Скорость создания | Несколько недель на объем | 25 статей всего за 15 минут |

| Качество текстов | Зависит от автора | 100% оригинальность по text.ru |

| Стоимость работы | От 3000 рублей за лонгрид | Доступно от 600 руб. за штуку |

| Публикация в CMS | Делается руками менеджера | Автоматически в WordPress, Modx, Bitrix |

Жесткий контроль качества материалов

Почему важна именно нейросетевая сборка? Когда проект требует заливки сотен описаний товаров, ручной контроль превращается в ад. Менеджер тратит часы на вычитку. Наша система получает данные о семантике, анализирует хвосты конкурентов из топа и выдает готовый html-код.

Перед отправкой клиенту каждый материал проходит сложную тройную проверку. Мы внимательно следим за тем, чтобы метрика AI-детекции не превышала 15%. Это гарантирует полную безопасность для продвижения. Поисковик воспринимает такой текст как написанный живым человеком.

FAQ по дублям и позициям в Яндексе

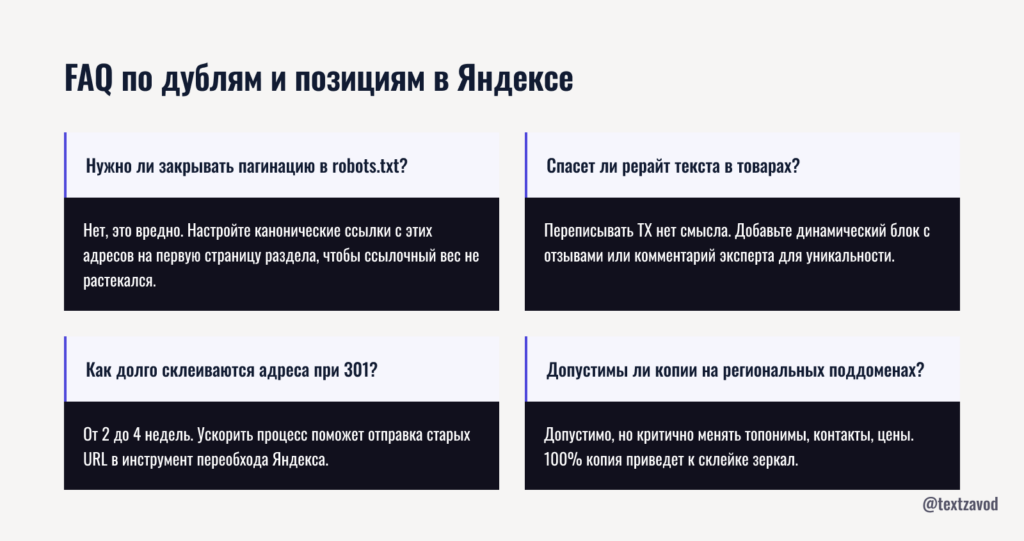

Часто коллеги задают мне одни и те же вопросы про борьбу с копиями страниц. Я собрала самые частые сомнения seo-специалистов и маркетологов. Ниже даю короткие и максимально прямые ответы из своей ежедневной практики.

Вопрос: Нужно ли закрывать от индексации страницы пагинации каталога?

Ответ: Нет, блокировать их через robots.txt крайне вредно. Робот должен свободно видеть всю структуру вашего магазина. Лучше настроить канонические ссылки с этих адресов на первую страницу раздела, чтобы ссылочный вес не растекался.

Вопрос: Спасет ли ситуацию простая переработка текста в карточках товаров?

Ответ: Полностью переписывать скучные технические характеристики нет смысла. Гораздо эффективнее добавить динамический блок с отзывами или небольшой экспертный комментарий. Это даст нужный объем оригинального текста без лишних затрат.

Вопрос: Как быстро алгоритмы склеят адреса после настройки 301-редиректа?

Ответ: Обычно на полную переиндексацию и перенос веса уходит от двух до четырех недель. Скорость напрямую зависит от лимитов краулера. Ускорить процесс поможет отправка старых адресов в инструмент переобхода через консоль вебмастера.

Вопрос: Влияет ли одинаковый текст на поддоменах для разных регионов России?

Ответ: Для локального продвижения это допустимая норма. Но критически важно менять топонимы, местные контактные данные, условия доставки и цены. Полная стопроцентная копия приведет к склейке зеркал и вылету из региональной выдачи.

| Читайте подробнее о том, как работает платформа, на textzavod.ru. |