Правильная robots.txt настройка seo определяет, какие именно страницы вашего сайта попадут в поисковый индекс Яндекса и Google. Ошибки в этих системных файлах полностью блокируют сканирование краулерами. Из-за этого ваши новые экспертные статьи месяцами висят без целевого органического трафика.

В этой инструкции мы детально изучим частые технические проблемы с индексацией. Вы узнаете четкий алгоритм поиска критических ошибок. Вы научитесь экономить краулинговый бюджет и поймете базовые принципы работы поисковых роботов. Меня зовут Максим, я работаю в команде Текст-Завода. Мы ежедневно парсим топ-30 Яндекса и видим у конкурентов одни и те же недочеты. Исправим их прямо сейчас.

Что делать при случайной блокировке всего сайта

Самая пугающая техническая ошибка — это короткая строка Disallow в корневом файле. Она строго запрещает поисковым ботам переходить по любым внутренним ссылкам веб-ресурса. Ваш коммерческий проект моментально и полностью выпадает из поиска.

Проблема обычно кроется в невнимательности программистов. Разработчики логично закрывают тестовый сервер от сканирования алгоритмами. При финальном переносе проекта на боевой домен они банально забывают удалить один символ слэша. В результате огромный портал становится невидимкой.

В 2025 году аналитики Cloudflare выяснили интересный факт. Только 37 процентов из проверенных топовых сайтов имеют корректно настроенный файл ограничений. Остальные компании регулярно теряют посетителей из-за мелких опечаток.

Алгоритмы поисковиков воспринимают правила буквально. Если вы поставили запрет, бот развернется и уйдет. Он не будет проверять качество ваших текстов или внешний ссылочный профиль.

Всегда проверяйте доступность проекта после любых технических релизов.

| Попробуйте собрать свой первый контент-план в Текст-Заводе — 10 статей за 2 900 руб., первый результат через 15 минут. Мы генерируем материалы через Gemini и Claude. Публикация идет сразу в WordPress, Modx или Bitrix с правильными SEO-настройками. |

Таблица 1. Последствия неправильных директив

| Текстовая директива | Реакция робота Яндекса | Реакция алгоритма Google |

| Строка Disallow: / | Полный отказ от сканирования ресурса | Удаление всех урлов из выдачи |

| Знак звездочки * | Игнорирование всех товарных страниц | Полная блокировка краулера |

| Команда Allow: / | Глубокое сканирование всего сайта | Нормальная и быстрая индексация |

| Пустой документ | Индексация разрешена по умолчанию | Индексация разрешена по умолчанию |

Вы можете легко потерять месяцы упорной работы из-за одной строчки. Поэтому технический аудит всегда начинается с проверки корня сайта.

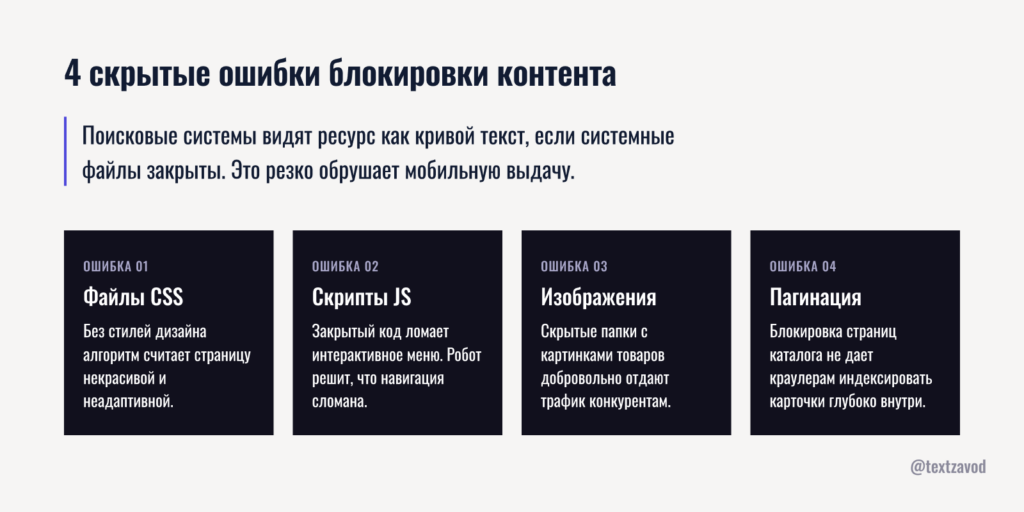

4 скрытые ошибки блокировки контента

Часто владельцы сайтов случайно скрывают от ботов важные рабочие скрипты, стили дизайна или картинки. Из-за этого поисковые системы видят ресурс как кривой текст без верстки. Это резко обрушает позиции в мобильной выдаче.

Многие старые версии CMS автоматически генерируют файлы с запретом на чтение системных папок CSS и JS. Десять лет назад это экономило вычислительные мощности сервера. Сейчас алгоритмы строго оценивают мобильную адаптивность проекта.

По данным исследования HTTP Archive, 8.43 процента десктопных версий имеют сбои в файлах ограничений. Роботы получают ответ 404 или некорректные правила для рендеринга визуала.

Если бот не может скачать таблицу стилей, он считает страницу некрасивой. Позиции всего домена сразу падают.

Какие элементы категорически нельзя скрывать:

- Файлы визуальных стилей CSS для корректного отображения. Они помогают алгоритму оценить реальный дизайн вашей страницы.

- Исполняемые скрипты JS для работы интерактивного меню и кнопок. Без них робот решит, что навигация полностью сломана.

- Папки с оптимизированными изображениями продуктов. Вы добровольно отказываетесь от хорошей доли целевого трафика.

- Страницы пагинации товарного каталога. Краулеры должны свободно индексировать карточки товаров глубоко внутри разделов.

| Если устали тратить время на ручной анализ поисковой выдачи — Текст-Завод парсит топ-30 и строит контент-план сам. Платформа автоматизирует производство контента полного цикла. Мы выдаем 25 статей за 15 минут, от 600 руб. за штуку. |

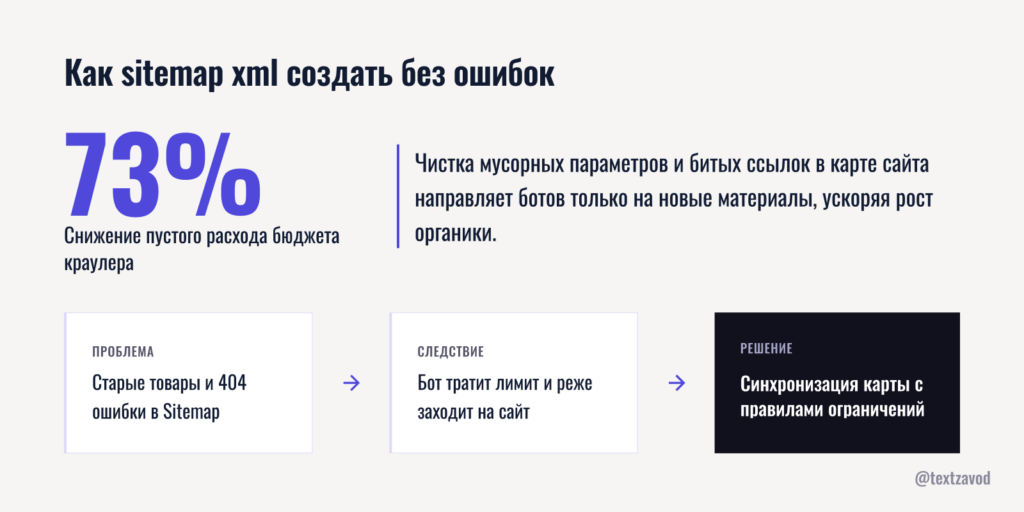

Как sitemap xml создать без ошибок

Карта сайта помогает поисковым роботам моментально находить свежие адреса страниц. Ошибки в этом файле приводят к растрате краулингового бюджета. Боты сканируют мусорные дубли вместо ваших новых материалов.

Новички часто спрашивают о том, как sitemap xml создать без технических косяков. Главная проблема всегда кроется в наличии битых или устаревших ссылок. Вы удалили старый товар, но урл остался в карте.

Поисковый робот приходит по такой ссылке и получает ошибку 404. Он тратит свое время впустую. Если таких ошибок много, бот начинает реже заходить на ваш сайт.

Вторая проблема — жесткий конфликт с правилами ограничений. Вы закрыли раздел каталога от индексации, но оставили ссылки на него в карте. Это сильно путает поисковые алгоритмы.

По свежей статистике LinkGraph за 2026 год, чистка мусорных параметров снижает пустой расход бюджета краулера на 73 процента. Органический трафик при этом стабильно растет.

| Хотите посмотреть, как это работает вживую? Зайдите на textzavod.ru — там есть примеры готовых статей и отчетов проверки. Мы гарантируем 100 процентов уникальности по text.ru и уровень AI-детекции строго до 15 процентов. |

Влияние формата дат на сканирование

Обязательно проверяйте формат вывода дат в теге обновления контента. Он строго должен соответствовать международному стандарту W3C Datetime. Если вы напишете дату обычным текстом, робот просто проигнорирует этот полезный сигнал.

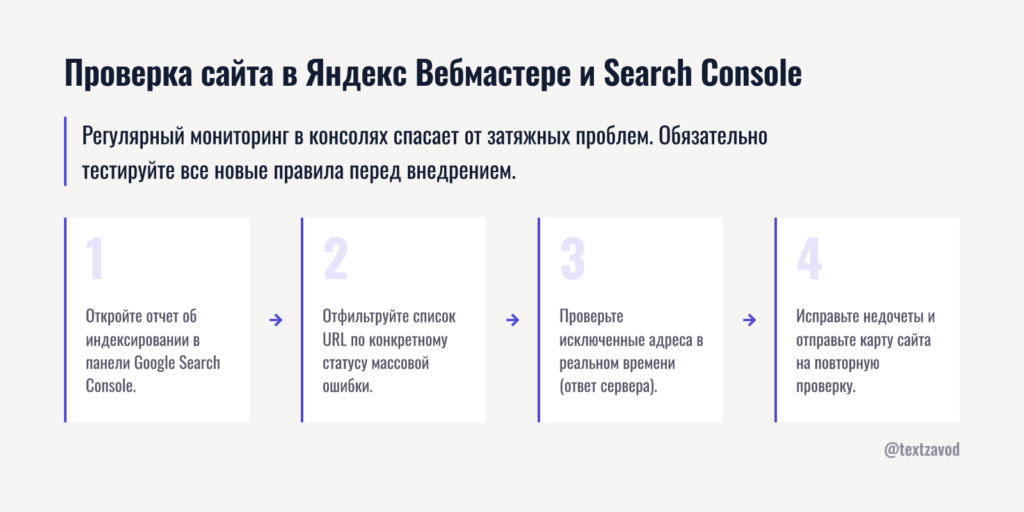

Проверка сайта в Яндекс Вебмастере и Search Console

Регулярный мониторинг в консолях вебмастеров надежно спасает от затяжных проблем с индексацией. Вы сразу замечаете, какие разделы резко выпали из поисковой базы.

В Яндекс Вебмастере есть отличные встроенные инструменты для тестирования файлов. Они показывают ваши страницы именно глазами поискового бота. Обязательно тестируйте все новые правила перед внедрением.

Анализатор Яндекса проверяет карту сайта на наличие дублей ссылок и ошибок кода. Консоль Google выдает очень подробный отчет о покрытии индекса. Там четко видно причины исключения каждого урла.

Пошаговый поиск скрытых сбоев:

- Откройте отчет об индексировании страниц в панели Google Search Console. Здесь хранятся все данные о сканировании.

- Отфильтруйте длинный список урлов по конкретному статусу ошибки сканирования. Начните с самых массовых проблем.

- Проверьте исключенные адреса через инструмент проверки в реальном времени. Это покажет ответ сервера.

- Исправьте выявленные недочеты и отправьте измененную карту сайта на повторную проверку.

| Попробуйте Trial: 10 статей, полный цикл от анализа до публикации. Один клиент окупает. Наша система разрабатывает контент-план на 25-30 статей на основе глубокой аналитики. Вы получаете готовый результат с правильной технической разметкой. |

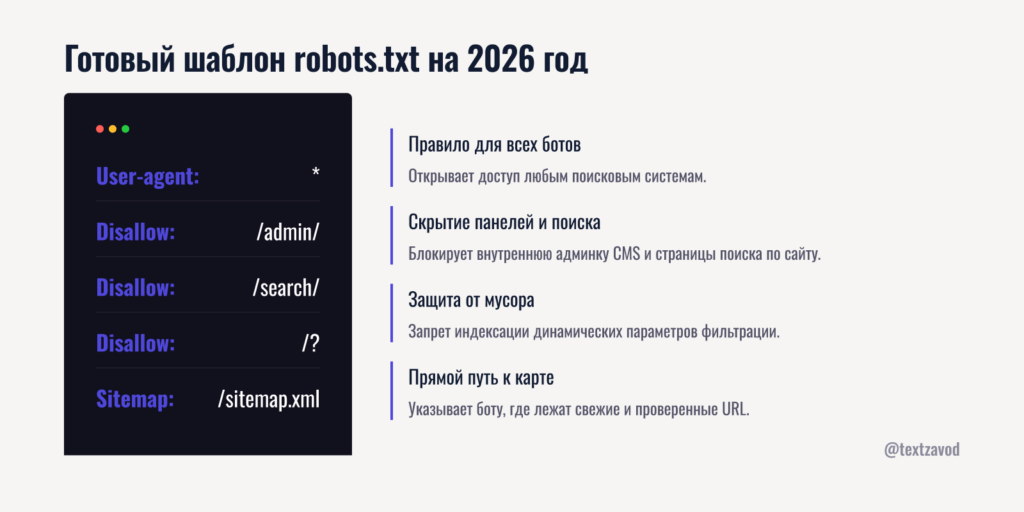

Готовый шаблон robots.txt на 2026 год

Создание рабочего набора правил требует предельной внимательности и аккуратности. Этот базовый шаблон отлично подходит для большинства стандартных контентных проектов. Он открывает нужные статьи и скрывает системный мусор.

Ваша главная цель — показать роботу прямой путь к карте сайта. При этом нужно скрыть административные панели вашей CMS. Директива Host уже давно не учитывается Яндексом. Для зеркал мы применяем только 301 серверные редиректы.

Ниже мы приводим универсальный рабочий код для коммерческих блогов. Скопируйте его и внимательно адаптируйте под свой движок.

Таблица 2. Структура файла для быстрой настройки

| Логический блок | Программный код | Подробное описание |

| Основной узел | User-agent: * | Правило действует абсолютно для всех ботов |

| Первый запрет | Disallow: /admin/ | Полное скрытие внутренней панели управления |

| Второй запрет | Disallow: /search/ | Блокировка страниц внутреннего поиска по сайту |

| Третий запрет | Disallow: /? | Запрет индексации динамических параметров фильтрации |

| Путь к карте | Sitemap: https://site.ru/sitemap.xml | Прямая ссылка на вашу карту |

Этот короткий шаблон навсегда убережет вас от типичных ошибок. Обязательно замените тестовый домен на свой реальный адрес. Проверьте итоговый файл валидатором перед загрузкой.

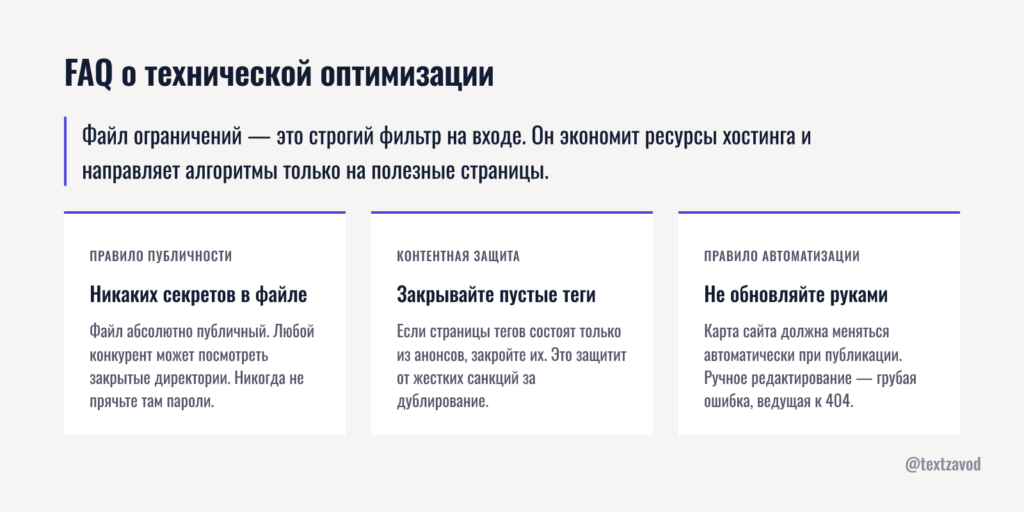

FAQ о технической оптимизации

В этом блоке мы собрали прямые ответы на популярные вопросы маркетологов. Здесь разобраны тонкости технической работы с файлами индексации.

Зачем вообще нужен файл ограничений

Он работает как строгий фильтр на входе на ваш сервер. Документ говорит поисковикам, какие разделы можно сканировать. Это здорово экономит ресурсы хостинга и направляет ботов только на полезные страницы.

Можно ли скрыть от конкурентов структуру сайта

Нет, этот текстовый файл абсолютно публичный. Любой человек может добавить адрес документа к вашему домену. Он легко посмотрит все закрытые вами секретные директории. Никогда не пишите туда пароли.

Нужно ли закрывать теги блога

Это сильно зависит от вашей контентной стратегии. Если страницы тегов состоят только из коротких анонсов, их лучше закрыть. Это надежно защитит проект от жестких санкций за дублирование контента.

Как часто следует обновлять карту сайта

Хорошая карта сайта должна обновляться полностью автоматически. Она меняется при публикации каждого нового текста. Ручное редактирование файла — это грубая ошибка. Используйте проверенные плагины для автоматизации процесса.

| Читайте подробнее о том, как работает платформа, на textzavod.ru. Вы получите контент-план на 25-30 статей и тексты с идеальной оптимизацией. Мы забираем всю скучную рутину на себя. |