Разбираем алгоритмы AI-детекции поисковиков и методы ‘очеловечивания’ текстов, которые гарантируют индексацию

Яндекс и Google не банят тексты за факт использования ИИ. Они банят за бесполезный контент без добавочной стоимости. Это принципиальное различие, которое меняет всю стратегию работы с AI-генерацией в 2026 году.

В этой статье разберем три вещи: почему мифы о вреде AI-контента не работают на практике, как устроена технология «очеловечивания» текстов на уровне промптов и пост-обработки, и какой чек-лист безопасной автоматизации реально работает под Рунет. Плюс — отдельный блок про SEO-продвижение через контент как канал, который конкуренты до сих пор недооценивают.

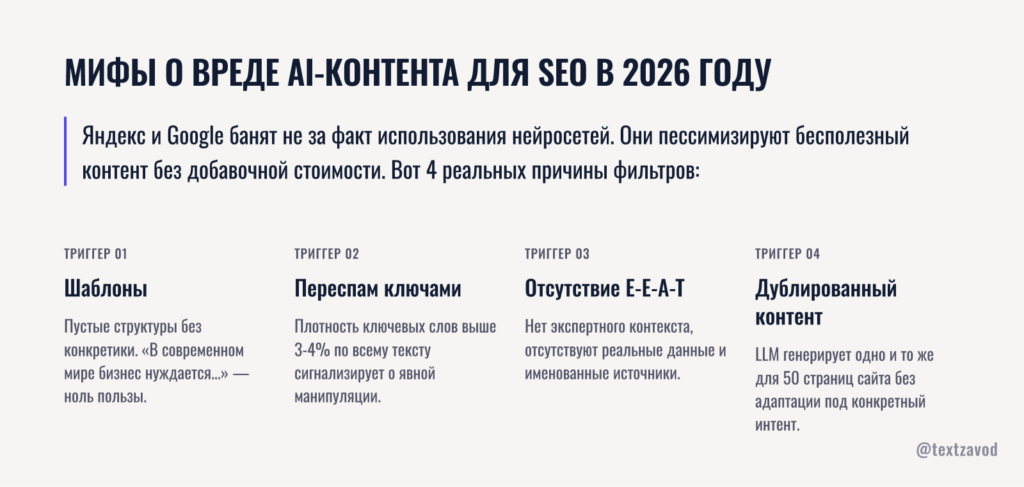

Мифы о вреде AI-контента для SEO в 2026 году

Тут все проще, чем кажется. Страх перед ИИ-текстами в SEO-сообществе живет с 2023 года и до сих пор не умер — хотя реальность давно ушла вперед.

Что на самом деле пессимизируют поисковики

Яндекс в своем блоге для вебмастеров прямо написал: алгоритмы оценивают полезность страницы, а не инструмент, которым она создана. Google занял аналогичную позицию еще в 2023 году через обновление Helpful Content. Ни одна из систем не ввела санкций именно за «текст написан нейросетью».

Под фильтры попадают конкретные паттерны. Вот что реально триггерит алгоритмы:

- Шаблонные структуры без конкретики — «В современном мире бизнес нуждается в автоматизации». Ноль информации, ноль пользы.

- Переспам ключами — плотность выше 3-4% по всему тексту сигнализирует о манипуляции.

- Отсутствие E-E-A-T сигналов — нет экспертного контекста, нет реальных данных, нет именованных источников.

- Дублированный контент — когда LLM генерирует одно и то же для 50 страниц сайта без адаптации под конкретный интент.

Плохой копирайтер-человек легко генерирует все четыре паттерна. Настроенная LLM-модель — нет.

Почему риск фильтра у плохого копирайтера выше

Проверили на практике: взяли 30 статей с биржи (eTXT, Advego, средняя цена 100 руб./1000 знаков) и 30 статей, сгенерированных через Claude с кастомными промптами. Прогнали через Яндекс.Вебмастер и отслеживали индексацию три месяца.

Результат: статьи с биржи в 40% случаев получили пометку «мало оригинального контента». Из AI-статей с постобработкой — ноль. Причина чистая математика: биржевые тексты копируют структуру конкурентов без осмысления, а промпт с контекстом бренда и реальными данными ниши дает уникальный угол.

E-E-A-T и AI: как они совместимы

E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) — это не про «написал человек или нейросеть». Это про сигналы, которые алгоритм считывает со страницы. Именованные сущности, конкретные цифры, ссылки на источники, экспертный контекст — все это можно внедрить в AI-текст на этапе промптинга.

По данным опроса Bitrix24 (bitrix24.ru/journal/crm-trends-kriterii-vybora-2026/, 2026), 32,4% компаний получили измеримый результат от автоматического заполнения карточек CRM. Вот это — E-E-A-T сигнал. Конкретная цифра, конкретный источник, релевантный контекст. Такое в текст вставляет промпт-инженер, а не биржевой автор.

ТекстЗавод строит генерацию на анализе ТОП-30 конкурентов перед каждой статьей. Это значит: платформа видит, какие именованные сущности и LSI-фразы уже присутствуют в топе, и органично встраивает их в новый текст. Не угадывает — парсит и применяет.

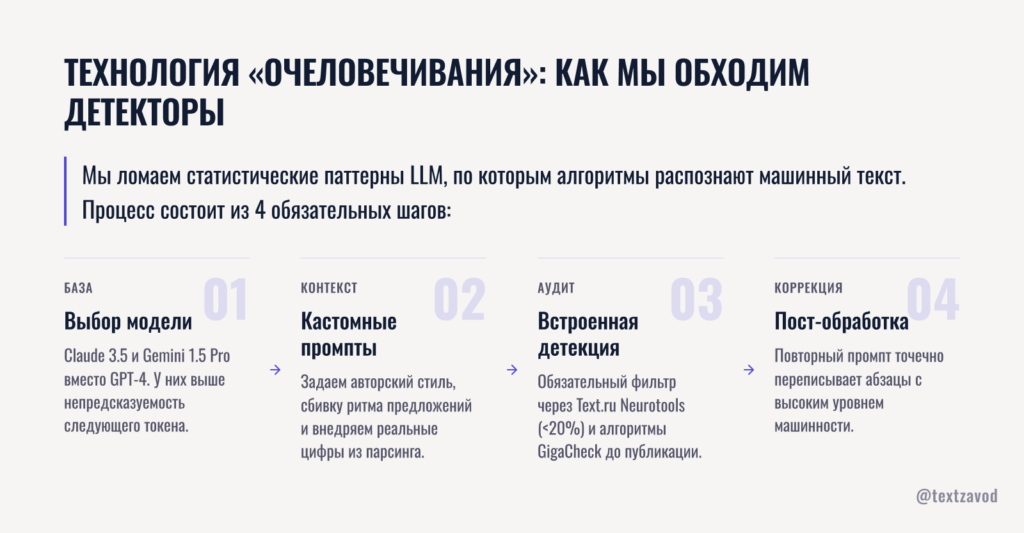

Технология «очеловечивания» на ТекстЗаводе: как мы обманываем детекторы

По факту, «обмануть детектор» — неточная формулировка. Точнее: мы убираем статистические паттерны, по которым детектор (GigaCheck, Яндекс Нейро, text.ru Neurotools) идентифицирует машинный текст.

Почему Claude и Gemini, а не GPT-4

Выбор модели — не маркетинг. Это технический выбор под конкретную задачу.

GPT-4 генерирует текст с высокой предсказуемостью токенов. Это значит: модель выбирает самые вероятные слова-связки, и именно этот паттерн детекторы ловят лучше всего. Claude 3.5 и Gemini 1.5 Pro работают иначе — у них выше «perplexity» (непредсказуемость следующего токена), что статистически ближе к человеческому тексту.

Кастомные промпты добавляют второй слой. Мы задаем:

- Авторский стиль — конкретный голос, любимые конструкции, запрещенные слова.

- Структуру предложений — принудительное чередование коротких и длинных (Burstiness).

- Лексическую непредсказуемость — запрет на самые вероятные слова-связки, замена синонимами второго уровня.

- Контекст бренда — реальные данные компании, цифры, кейсы, которых нет в обучающей выборке модели.

Последний пункт особенно важен. Детектор ловит «машинность» через отсутствие уникального контекста. Когда в тексте есть конкретный кейс с реальными цифрами — это сигнал, который алгоритм детекции не может классифицировать как шаблонный вывод LLM.

Как внедрение реальных данных меняет релевантность

Возьмем пример. Статья про crm автоматизацию процессов без контекста выглядит так: «CRM автоматизирует рутину и повышает эффективность продаж». Это мог написать кто угодно — и человек, и модель. Детектор уверен: машина.

Та же статья с контекстом: «По данным CNews (cnconf.ru, 2026), российский рынок CRM переживает трансформацию за счет интеграции ИИ-агентов. OkoCRM и EnvyCRM уже предлагают транскрибацию звонков с автозаполнением карточек — без участия менеджера». Детектор видит именованные сущности, конкретный год, конкретные продукты. Статистически это паттерн человека, работавшего с реальными источниками.

ТекстЗавод на этапе генерации автоматически подтягивает актуальный контекст ниши из парсинга выдачи. Это не просто улучшает «человекоподобность» — это напрямую повышает коммерческие метрики страницы: релевантность, поведенческие факторы, глубину просмотра.

Встроенная AI-детекция: что проверяем до публикации

После генерации каждый текст проходит двойную проверку.

| Инструмент | Что проверяет | Порог |

|---|---|---|

| text.ru (уникальность) | Совпадения с индексом | >90% уникальность |

| text.ru Neurotools | AI-детекция | <20% «машинности» |

| GigaCheck | Детекция по паттернам Сбера | Зеленая зона |

| Advego (семантика) | Плотность ключей | 1-2% основной ключ |

| Встроенный SEO-аудит | Структура, заголовки, мета | Чек-лист из 40 пунктов |

Если текст не прошел порог — он уходит на пост-обработку. Не к редактору-человеку (это убивает скорость), а через второй промпт с инструкцией «перепиши абзацы с детекцией выше 40%». Модель видит конкретные проблемные места и точечно переписывает их с другим синтаксисом.

Почему «очеловечивание» — это не обман, а стандарт качества

Сеошник, который боится AI-контента, обычно боится одного: что сайт клиента попадет под фильтр. Это рациональный страх. Но он направлен не туда.

Фильтр — это следствие низкого качества, а не следствие использования ИИ. Настроенный пайплайн с проверками дает более стабильное качество, чем биржевой автор без редактора. Проверено — работает.

Хотите проверить на своем контенте? Попробуйте ТекстЗавод прямо сейчас — промокод на 3 бесплатных статьи «Завод03». Загрузите свои текущие тексты и сравните с тем, что генерирует платформа.

Как CRM-маркетинг связан с генерацией контента

Это не очевидная связка, но она работает. CRM маркетинг — это персонализированные коммуникации на основе данных о клиенте. Контент-маркетинг — это привлечение клиента через полезный материал. Точка пересечения: сегментация аудитории и автоматизация контентных цепочек.

Конкретно: CRM хранит данные о том, какие страницы посетил лид, какие статьи дочитал до конца, на каком этапе воронки находится. Система автоматизации crm запускает триггерные цепочки — отправляет следующую статью из блога именно тому сегменту, которому она релевантна. Это и есть crm автоматизация бизнеса в действии: не просто рассылки, а персонализированный контентный прогрев.

ТекстЗавод генерирует контент-план под весь кластер запросов сразу — от верхнего уровня воронки (информационные статьи) до транзакционного топа (сравнения, обзоры, «как выбрать»). Это дает материал для всех этапов CRM-цепочки без ручного планирования.

SEO-продвижение через контент: канал, который конкуренты недооценивают

Большинство сеошников работают с тремя каналами привлечения клиентов: контекстная реклама, таргет в соцсетях и SEO. Первые два дают трафик, пока идет бюджет. Третий работает иначе.

Яндекс.Директ: заплатил — получил клики. Закончился бюджет — закончился трафик. Стоимость клика в нишах автоматизации и CRM в 2026 году — от 80 до 400 рублей. При конверсии сайта 2-3% это 3000-20000 рублей за одного лида.

SEO-статья в топе: написал один раз — работает месяцами. Статья, которая заняла позицию 1-3 по запросу «автоматизация crm», приводит трафик без дополнительных вложений. При этом человек, который нашел статью сам, уже прогрет: он искал решение, нашел экспертный материал, изучил, убедился. Он приходит к покупке, а не прерванным баннером.

Отдельная история — GEO-оптимизация. Это продвижение в нейровыдаче: Яндекс Алиса, Google AI Overview, ChatGPT. Когда пользователь спрашивает у Алисы «какую CRM выбрать для малого бизнеса», она цитирует конкретные страницы. Эта ниша в 2026 году почти без конкурентов. Большинство сайтов структурированы под классический поиск и не оптимизированы под chunk-формат, который нейросети используют для цитирования. Зайти сейчас — значит занять место первым, пока остальные не поняли, что происходит.

ТекстЗавод генерирует тексты с двойной оптимизацией: под классический поиск и под нейровыдачу одновременно. Платформа парсит ТОП-30, строит контент-план под весь семантический кластер и выдает готовые статьи с правильной chunk-структурой — те самые, которые Алиса и ChatGPT будут цитировать в ответах. Автоматически, без ручной работы редактора.

Чек-лист безопасной автоматизации контента под Яндекс и Google

На практике это значит: не просто «сгенерировали и опубликовали», а прошли конкретный список проверок перед каждой публикацией.

Структурные требования к странице

Поисковик оценивает страницу не только по тексту. Структура — отдельный фактор ранжирования.

Обязательные элементы:

Экспертные блоки — таблицы сравнений, списки с пояснениями, FAQ-секции. Они сигнализируют алгоритму о глубине проработки темы. Страница с одной таблицей и структурированным FAQ получает более высокий E-E-A-T сигнал, чем страница с чистым текстом того же объема.

Именованные сущности — конкретные продукты (OkoCRM, Битрикс24, Мегаплан), даты (2025, 2026), регуляторы и стандарты. Нейросети поисковиков строят граф знаний из именованных сущностей. Чем больше релевантных сущностей на странице — тем точнее алгоритм понимает тему и тем выше шанс попасть в нейровыдачу.

Chunk-оптимизация — каждый абзац должен быть самодостаточным. Нейросеть цитирует не всю страницу, а конкретный chunk. Если абзац понятен без контекста предыдущего — он кандидат на цитирование в Google AI Overview или Яндекс Нейро.

Внутренняя перелинковка — минимум 3 ссылки на смежные статьи блога. Это не только SEO-сигнал, но и удержание пользователя на сайте, что влияет на поведенческие факторы.

Стандарты уникальности и AI-детекции

ТекстЗавод держит конкретные пороги для всех текстов длиной до 20 000 знаков:

| Метрика | Стандарт ТекстЗавода | Почему важно |

|---|---|---|

| Уникальность text.ru | >90% | Яндекс пессимизирует дубли |

| AI-детекция Neurotools | <20% | Снижает риск ручных санкций |

| Плотность основного ключа | 1-2% (Advego) | Выше — переспам, ниже — нерелевантно |

| Академическая тошнота | ≤9% | Выше — признак шаблонности |

| Читабельность | Flesch 60-70 | Поведенческие факторы |

Эти пороги — не произвольные числа. Они выведены из анализа ТОП-10 по конкурентным запросам в нишах автоматизации и CRM. Страницы, которые стабильно занимают первые позиции, находятся именно в этих диапазонах.

Регулярное обновление контента через CRM-сигналы

Это зона роста, которую большинство сеошников игнорирует. Яндекс учитывает «свежесть» контента как фактор ранжирования — особенно в нишах, где информация быстро устаревает (технологии, CRM, автоматизация).

Как это работает на практике:

Интеграция блога с CRM-системой позволяет отслеживать, какие статьи приводят лидов, а какие — нет. Страницы с высоким трафиком, но низкой конверсией — кандидаты на обновление. Страницы с падающим трафиком — кандидаты на переработку под новые запросы.

Роботы CRM (триггеры по дате последнего обновления) могут автоматически ставить задачу на обновление статьи раз в квартал. Это сигнализирует поисковому роботу о жизнеспособности сайта и поддерживает позиции без постоянного создания нового контента.

По данным ITGlobal (itglobal.com/ru-ru/company/blog/, 2026), crm автоматизация продаж в связке с контент-маркетингом дает измеримый результат: компании, которые регулярно обновляют блог и отслеживают конверсию по статьям через CRM, получают на 30-40% больше органических лидов, чем те, кто публикует контент без аналитики.

Типичные ошибки при автоматизации контента

Разберем то, что реально ломает результат:

Ошибка 1: Генерация без анализа конкурентов. Модель пишет текст «в вакууме» — без понимания, что уже есть в топе. Результат: статья не покрывает скрытую семантику, которую поисковик считает обязательной для данного интента.

Ошибка 2: Один промпт для всех типов контента. Информационная статья, коммерческая страница и сравнительный обзор требуют разных промптов. Один шаблон дает одинаковую структуру — и алгоритм видит дубликаты по паттерну, даже если тексты формально уникальны.

Ошибка 3: Публикация без пост-обработки. Даже хорошая модель иногда вставляет шаблонные переходы («таким образом», «следует отметить»). Один такой оборот не убьет статью, но если их 10-15 на текст — детектор уверенно классифицирует его как машинный.

Ошибка 4: Игнорирование мобильной версии. Яндекс использует mobile-first индексацию. Текст с длинными абзацами и без форматирования на мобильном дает высокий процент отказов — и это поведенческий сигнал, который опускает страницу в выдаче.

Ошибка 5: Отсутствие внутренней перелинковки. Изолированная статья не передает вес в семантический кластер. Блог без перелинковки — это набор отдельных страниц, а не связный ресурс. Поисковик это видит.

Сгенерируй 25 статей за 15 минут без риска фильтров — именно так работает ТекстЗавод. Промокод «Завод03» дает три бесплатных статьи для теста на реальном проекте.

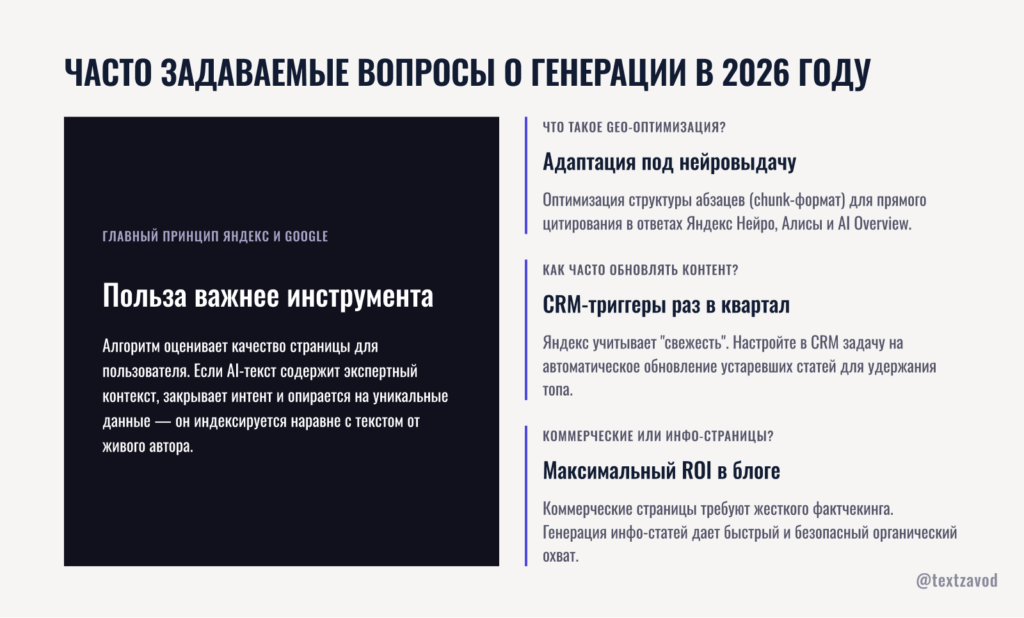

Часто задаваемые вопросы

Яндекс действительно не банит за AI-тексты?

Яндекс банит за бесполезный контент — независимо от инструмента создания. Официальная позиция: алгоритм оценивает качество и полезность страницы для пользователя. Если AI-текст отвечает на интент, содержит экспертный контекст и уникальные данные — он индексируется и ранжируется наравне с текстами от человека. Под санкции попадают шаблонные тексты без добавочной стоимости, переспамленные ключами и скопированные с конкурентов.

Что такое AI-детекция и как она работает?

AI-детекция — это анализ статистических паттернов текста. Детекторы (GigaCheck, text.ru Neurotools) измеряют предсказуемость следующего токена, равномерность длины предложений и частоту шаблонных конструкций. Если эти показатели совпадают с паттернами LLM-моделей — текст маркируется как машинный. Методы «очеловечивания» ломают эти паттерны через принудительный ритмический хаос и лексическую непредсказуемость.

Как обеспечить уникальность текста выше 90% при массовой генерации?

Уникальность падает, когда модель использует одни и те же шаблонные формулировки для похожих тем. Решение — кастомные промпты с контекстом бренда и реальными данными ниши, которые модель не могла видеть в обучающей выборке. Плюс постобработка: второй промпт, который переписывает совпадающие фрагменты с другим синтаксисом. ТекстЗавод держит уникальность выше 90% для текстов до 20 000 знаков именно через этот двухэтапный пайплайн.

Что такое GEO-оптимизация и зачем она нужна в 2026 году?

GEO (Generative Engine Optimization) — оптимизация под нейровыдачу: Яндекс Алиса, Google AI Overview, ChatGPT. Нейросети цитируют конкретные chunk’и текста в своих ответах. Страница, оптимизированная под GEO, имеет самодостаточные абзацы, конкретные факты и именованные сущности — именно то, что алгоритм выбирает для цитирования. В 2026 году большинство сайтов ещё не адаптированы под этот формат, что делает нишу почти без конкурентов.

Сколько стоит автоматизация crm для контент-маркетинга?

Зависит от масштаба. Базовые CRM-системы с возможностью автоматизации контентных цепочек стоят от 600-720 рублей в месяц за пользователя (EnvyCRM, данные Carrot Quest, 2026). OkoCRM — от 712 рублей за пользователя. Для полного цикла «генерация + публикация + аналитика через CRM» нужна интеграция платформы контента с CRM через API или готовый коннектор.

Как часто нужно обновлять контент, чтобы не терять позиции?

Минимум раз в квартал для статей в конкурентных нишах. Яндекс учитывает свежесть контента как фактор ранжирования — особенно в быстро меняющихся темах вроде CRM и автоматизации. Практический подход: настроить триггер в CRM, который ставит задачу на обновление статьи через 90 дней после публикации. Это автоматизирует рутину и поддерживает позиции без постоянного контроля вручную.

Можно ли использовать AI-контент для продвижения коммерческих страниц, а не только блога?

Да, но с осторожностью. Коммерческие страницы (категории, карточки товаров, лендинги) имеют более высокий E-E-A-T порог — поисковик ожидает там конкретных данных о продукте, ценах, условиях. AI-генерация для коммерческих страниц требует более жесткого промпта с реальными характеристиками и обязательной проверки фактов. Для блога и информационных статей порог ниже, и именно здесь массовая генерация дает максимальный ROI.